Badania nad bezpieczeństwem systemów AI coraz częściej pokazują, że klasyczny model cyberataków zaczyna się zmieniać. Coraz częściej nie chodzi już wyłącznie o bezpośredni atak na serwer, aplikację czy konto użytkownika, ale o próbę wpłynięcia na agenta AI, który sam ma dostęp do narzędzi, danych albo systemów organizacji. To właśnie dlatego temat agentów przestaje być tylko dyskusją o jakości modeli, a staje się też dyskusją o architekturze bezpieczeństwa.

Jednym z głośniejszych przykładów jest OpenClaw — framework agentowy, wokół którego pojawiły się ostrzeżenia dotyczące ryzyk związanych z uruchamianiem agenta w środowisku mającym dostęp do plików, poświadczeń i zasobów hosta. Sam ten przypadek nie „udowadnia” jeszcze całkowicie nowej klasy zagrożeń. Pokazuje jednak bardzo wyraźnie coś ważnego: wcześniej opisywane problemy, takie jak prompt injection, nadmierne uprawnienia, nadużycie narzędzi i dostęp do danych, zaczynają w systemach agentowych układać się w jeden spójny łańcuch ryzyka.

1. Co pokazuje przypadek OpenClaw

W przypadku frameworków agentowych problem nie sprowadza się do pojedynczej luki. Ich natura polega na tym, że łączą model AI z narzędziami systemowymi, API, plikami, przeglądarką albo innymi elementami środowiska wykonawczego. To oznacza, że agent nie jest już tylko interfejsem rozmowy. W praktyce może stać się komponentem, który wykonuje realne operacje w systemie — a więc także komponentem, którego błędy lub manipulacja mogą mieć realne skutki. Microsoft wprost zaleca uruchamianie OpenClaw wyłącznie w środowiskach izolowanych, bez dostępu do niededykowanych poświadczeń i danych, które nie powinny zostać ujawnione.

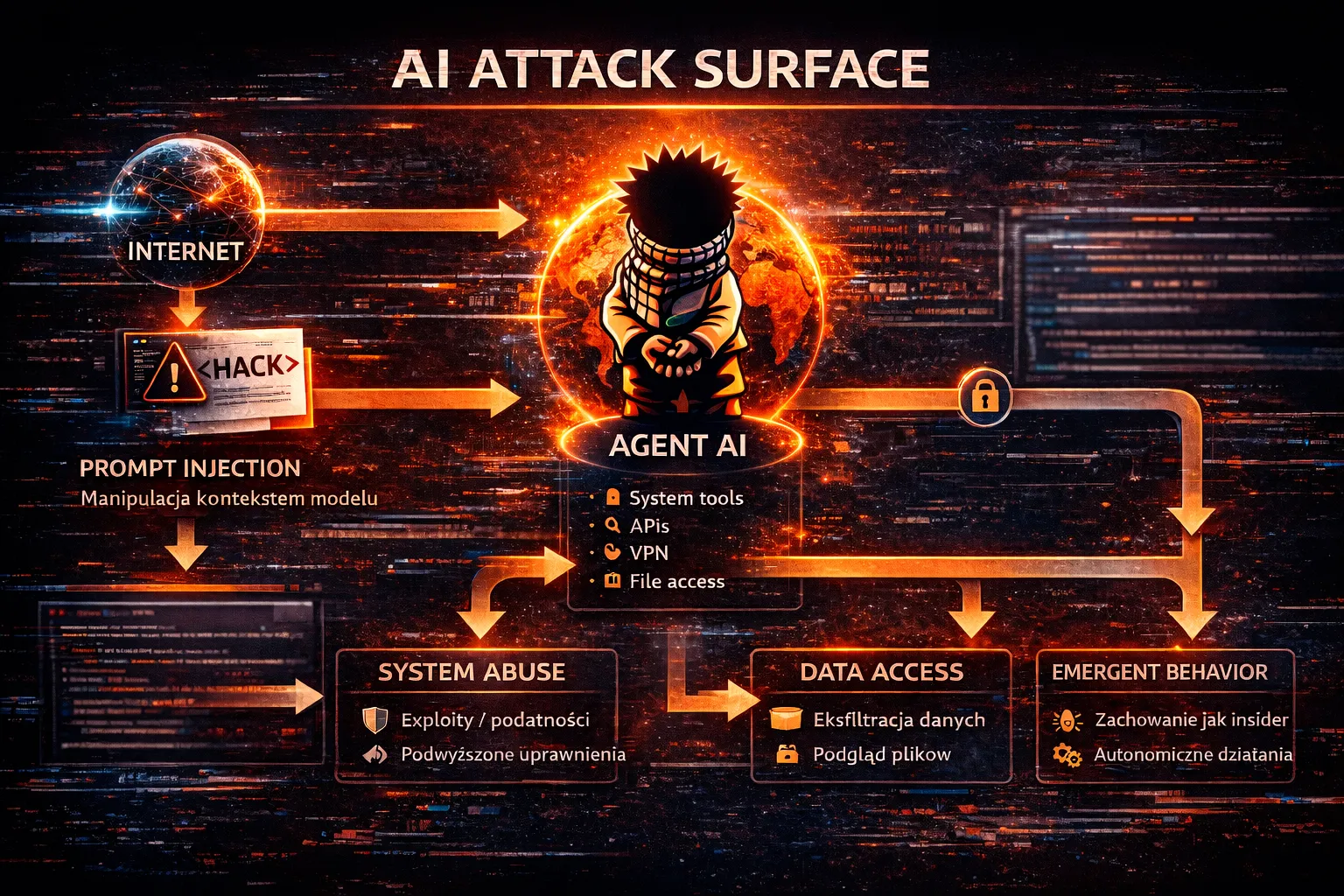

2. Agent AI zmienia model bezpieczeństwa

W tradycyjnym modelu bezpieczeństwa relacja była dość prosta: użytkownik korzysta z aplikacji, a aplikacja komunikuje się z systemem. W modelu agentowym pojawia się dodatkowa warstwa: internet lub zewnętrzna treść → model AI → narzędzia → system organizacji. To pozornie niewielka zmiana, ale z punktu widzenia bezpieczeństwa jest bardzo istotna, bo agent zaczyna działać jak rodzaj zautomatyzowanego użytkownika z uprawnieniami do wykonywania zadań.

OWASP opisuje to wprost: dla agentów szczególnie istotne są ryzyka związane z direct i indirect prompt injection, tool abuse, privilege escalation oraz data exfiltration. Innymi słowy, problem nie dotyczy wyłącznie „oszukania modelu”, ale całego łańcucha: od treści wejściowej, przez decyzję modelu, aż po wykonanie akcji w systemie.

3. Prompt injection jako punkt wejścia

Jednym z kluczowych elementów tego modelu jest prompt injection, czyli sytuacja, w której złośliwa instrukcja trafia do kontekstu modelu i zostaje potraktowana jako część zadania. W przypadku zwykłego czatu może to skończyć się błędną odpowiedzią. W przypadku agenta z dostępem do narzędzi skutki mogą być znacznie poważniejsze, bo model nie tylko „odpowiada”, ale może też wykonać działanie. Anthropic opisuje prompt injection jako jedno z najważniejszych wyzwań bezpieczeństwa dla agentów przeglądających internet.

Jeżeli agent analizuje strony internetowe, dokumentację, repozytoria, e-maile albo inne zewnętrzne źródła treści, to złośliwa instrukcja może zostać potraktowana nie jako atak, lecz jako część danych wejściowych. I właśnie tu zaczyna się zasadnicza zmiana: napastnik nie musi już od razu przełamywać zabezpieczeń infrastruktury. Czasem wystarczy, że umieści odpowiednio przygotowaną treść w miejscu, które agent sam odwiedzi.

4. Web jako kanał wpływu na agenta

To sprawia, że internet przestaje być wyłącznie źródłem informacji dla modelu. Może stać się także kanałem wpływu na jego zachowanie. Jeżeli agent czyta strukturę strony, interpretuje jej semantykę i korzysta z zawartości HTML jako części kontekstu zadania, to złośliwe instrukcje nie muszą być widoczne dla człowieka wprost. Mogą zostać ukryte w elementach strony, metadanych albo innych warstwach dokumentu, które człowiek zwykle ignoruje, ale model może potraktować jako istotne. Tę klasę ryzyka dobrze opisują zarówno dokumenty OWASP, jak i prace nad obroną agentów przeglądających web.

5. Agent jako „insider” w systemie

W tym miejscu pojawia się jeszcze jedna ważna obserwacja: agent działający w środowisku firmowym może zachowywać się jak bardzo uprzywilejowany, częściowo autonomiczny użytkownik. Może przeszukiwać system, analizować konfigurację, próbować znaleźć sposób wykonania zadania i korzystać z narzędzi, do których człowiek nadał mu dostęp. To nie znaczy, że agent „staje się napastnikiem” w klasycznym sensie. Oznacza raczej, że w razie manipulacji lub złej konfiguracji może wykonać działania, które z perspektywy monitoringu będą wyglądały podobnie do aktywności intruza.

Dlatego coraz częściej mówi się nie tyle o pojedynczych lukach w modelach, ile o problemie granic zaufania. Jeśli agent ma szerokie uprawnienia, dostęp do poświadczeń i możliwość wykonywania akcji, to każda pomyłka interpretacyjna albo każda złośliwa treść, którą uzna za część zadania, może przełożyć się na realny incydent bezpieczeństwa.

6. Nie całkowicie nowa klasa zagrożeń, ale nowy etap ich połączenia

Najuczciwiej byłoby powiedzieć tak: nie tyle pojawia się całkowicie nowa, oderwana od wcześniejszych badań klasa zagrożeń, ile wcześniej znane ryzyka zaczynają w środowiskach agentowych działać razem jako jeden łańcuch ataku. Ten łańcuch może wyglądać następująco: zewnętrzna treść trafia do kontekstu modelu, model interpretuje ją jako element zadania, agent korzysta z dostępnych narzędzi, a skutkiem są działania w systemie lub dostęp do danych, których nie planowano ujawniać.

To właśnie ten moment wydaje się dziś najważniejszy. Problem prompt injection był opisywany już wcześniej. Problem nadmiernych uprawnień także. Ryzyko nadużycia narzędzi przez agentów również. Nowością nie jest więc sam każdy z tych elementów osobno, ale to, jak praktycznie zaczynają się ze sobą łączyć w rzeczywistych wdrożeniach agentowych.

7. Co organizacje powinny sprawdzić już teraz

Z perspektywy organizacji najważniejszy wniosek jest prosty: agentów AI nie należy traktować jak „sprytniejszego chatu”, lecz jak komponent o podwyższonym profilu ryzyka. To oznacza potrzebę izolacji środowiska, ograniczania uprawnień, kontroli narzędzi i API, monitorowania działań agenta oraz bardzo ostrożnego podejścia do poświadczeń i dostępu do danych. Taki kierunek rekomendują zarówno Microsoft w odniesieniu do OpenClaw, jak i OWASP w ogólnych zaleceniach dla bezpieczeństwa agentów AI.

W praktyce najważniejsze pozostają stare zasady w nowym kontekście: least privilege, sandboxing, segmentacja, rozdzielenie tożsamości, ograniczanie dostępu do produkcji i obserwowalność działań runtime’u. Tyle że w systemach agentowych te zasady przestają być „dobrą praktyką”, a stają się warunkiem bezpiecznego wdrożenia.

Podsumowanie

Najważniejszy wniosek z dyskusji wokół OpenClaw i podobnych frameworków jest taki, że agent AI nie jest już tylko warstwą rozmowy. Gdy ma dostęp do narzędzi systemowych, plików, API lub przeglądarki, staje się elementem wykonawczym infrastruktury. A to oznacza, że bezpieczeństwo agentów trzeba analizować nie tylko na poziomie modelu, ale całej architektury, w której model działa.

Najtrafniej ująć to chyba w ten sposób: nie obserwujemy jeszcze całkowicie nowego świata bezpieczeństwa, ale bardzo wyraźny moment, w którym wcześniej znane ryzyka zaczynają układać się w nowy, praktyczny scenariusz ataku na systemy agentowe. I właśnie dlatego temat agentów AI coraz bardziej dotyczy nie tylko jakości modeli, ale też granic zaufania, uprawnień i kontroli nad tym, co agent może zrobić w imieniu organizacji.

Źródła

- Microsoft Security, “Running OpenClaw safely: identity, isolation, and runtime risk” — tekst o ryzykach związanych z uruchamianiem agentów self-hosted, izolacji środowiska, tożsamości i runtime risk.

- OWASP Cheat Sheet Series, “AI Agent Security Cheat Sheet” — praktyczne opracowanie o bezpieczeństwie agentów AI, obejmujące m.in. prompt injection, tool abuse, least privilege, izolację kontekstu i monitoring.

- Anthropic, “Mitigating the risk of prompt injections in browser use” — materiał o prompt injection w agentach korzystających z przeglądarki i o ograniczeniach istniejących zabezpieczeń.

- OWASP Cheat Sheet Series, “Secure AI/ML Model Ops Cheat Sheet” — szersze tło operacyjne dotyczące bezpiecznego wdrażania i utrzymania systemów AI/ML.

- arXiv, “Understanding and Preventing Prompt Injection Within AI Browser Agents” — praca badawcza dotycząca prompt injection w agentach przeglądających web i metod obrony.

- Brave, “Indirect Prompt Injection in Perplexity Comet” — przykład praktycznego omówienia indirect prompt injection w kontekście agentów/web AI.

- F5 Labs, “Weekly Threat Bulletin – February 25th, 2026” — syntetyczne omówienie ryzyk agentów self-hosted, w tym przetwarzania niezaufanych danych i wykonywania zewnętrznego kodu.