W dyskusji o agentach AI zbyt łatwo sprowadzić cały problem do prompt injection. To wygodne, ale mylące. Bo w realnych środowiskach zagrożenie rzadko kończy się na samym promptcie. Prawdziwy problem zaczyna się wtedy, gdy model działa w otoczeniu pełnym uprawnień, integracji i zaufanych workflow. Wtedy nie chodzi już tylko o injection. Chodzi o to, kto i przez co dostał prawo do działania.

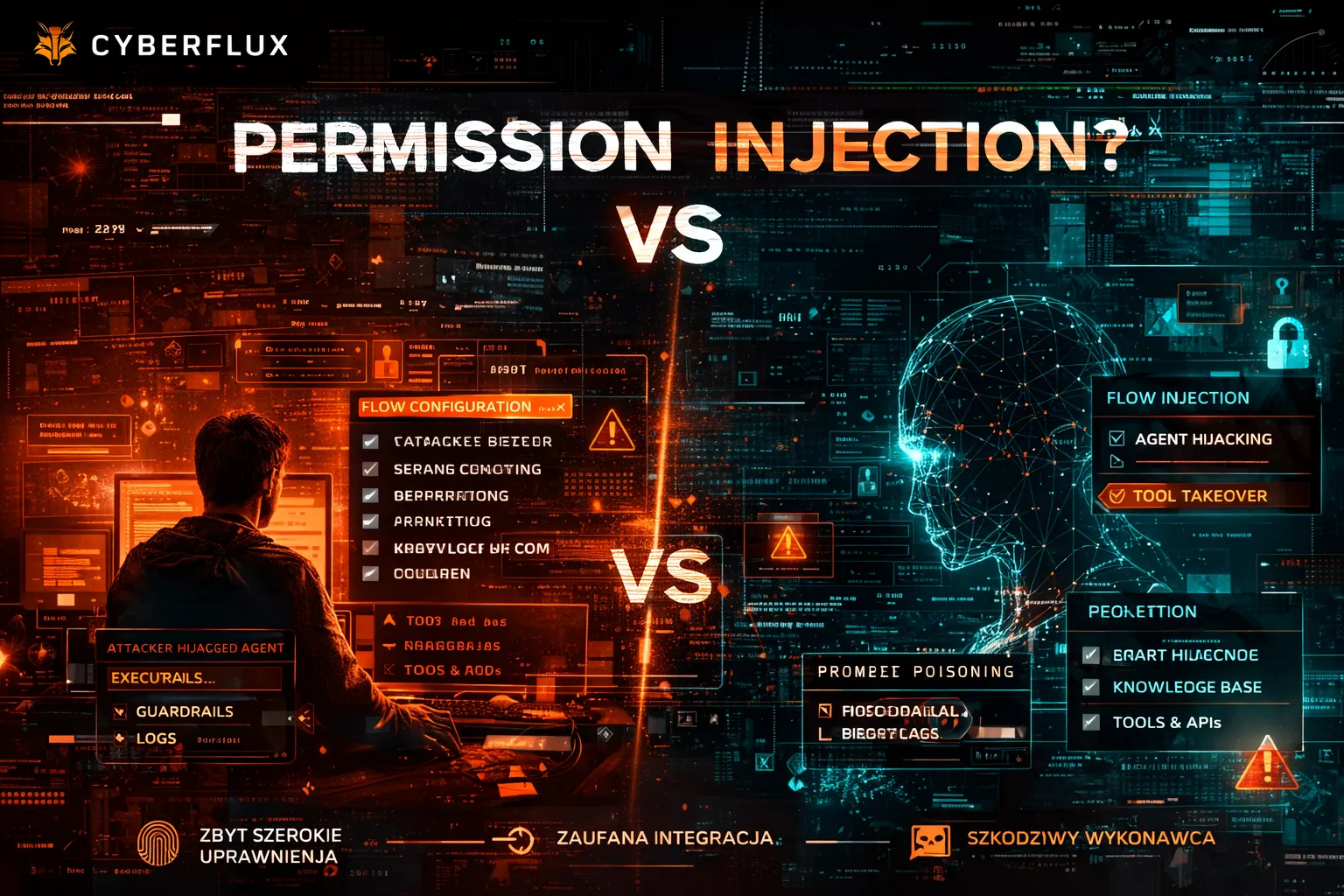

Najnowszy case wokół AWS Bedrock jest dobrym przypomnieniem, że agent AI nie jest po prostu „modelem, który odpowiada”. To wykonawca osadzony w architekturze: ma flow, ma pamięć, ma knowledge base, ma guardrails, ma logi, ma połączenia z innymi usługami. I właśnie dlatego badacze opisali tam osiem wektorów ataku, obejmujących między innymi agent hijacking, flow injection, guardrail degradation czy prompt poisoning. Wspólny mianownik tych scenariuszy nie brzmi jednak: „ktoś oszukał model”. Brzmi raczej: „ktoś wykorzystał możliwości, które system dostał wcześniej”.

To ważna zmiana perspektywy. Prompt injection bywa przedstawiany jak centralny problem agentów AI, jakby wszystko zaczynało się i kończyło na złośliwym ciągu znaków. Tymczasem sam prompt bardzo często jest tylko wejściem do większego układu zależności. Dopiero połączenie treści wejściowej z uprawnieniami, integracjami i automatyzacją zamienia manipulację w realny skutek operacyjny. Bez tego zasięg ataku bywa ograniczony. Z tym — staje się pełnoprawnym mechanizmem działania.

I właśnie dlatego określenie permission injection wydaje się tu ciekawsze niż samo prompt injection. Nie dlatego, że prompt injection przestaje istnieć. Tylko dlatego, że w środowiskach agentowych największe ryzyko nie bierze się z samej podatności na wpływ, ale z tego, co agent może zrobić, jeśli już ulegnie wpływowi. Problem nie polega wyłącznie na tym, że model przeczyta coś, czego nie powinien. Problem polega na tym, że po przeczytaniu może wykonać akcję, sięgnąć do danych, zmodyfikować przepływ albo uruchomić kolejny krok w zaufanym systemie.

To zresztą dobrze współgra z tym, jak sam AWS opisuje bezpieczeństwo Bedrock. W dokumentacji prompt injection jest traktowany jako problem, przed którym trzeba chronić aplikację i agenta za pomocą guardrails, separacji instrukcji, analizy wejścia i właściwego projektowania systemu. AWS przypomina też o modelu współdzielonej odpowiedzialności: infrastruktura po stronie dostawcy to jedno, ale zabezpieczenie aplikacji, danych i zasobów wdrożonych przez klienta pozostaje po stronie klienta. Innymi słowy: platforma może dostarczyć mechanizmy ochronne, ale nie rozwiąże za Ciebie problemu zbyt szerokich uprawnień i źle zaprojektowanego wykonania.

I tu dochodzimy do najważniejszej lekcji. W klasycznym myśleniu o bezpieczeństwie dużo uwagi poświęcało się obiektowi: plikowi, payloadowi, exploitowi, linkowi. W architekturach agentowych coraz częściej ważniejszy od obiektu staje się kontekst wykonania. To nie sam prompt jest najbardziej niebezpieczny. Najgroźniejsze jest to, że prompt trafia do wykonawcy działającego w środowisku, które już wcześniej wyposażono w zaufanie, narzędzia i możliwość podejmowania działań.

Właśnie tu Bedrock daje ciekawą lekcję dla całego rynku agentów AI. Model nie musi zostać „zhackowany” w spektakularnym sensie. Wystarczy, że atakujący przejmie lub podmieni elementy wokół niego: flow, prompt, guardrail, knowledge base, logowanie, sposób orkiestracji. Jeżeli system pozwala łączyć zewnętrzną treść z mechanizmem wykonania bez twardej separacji, to ryzyko rośnie skokowo. Wtedy prompt injection staje się tylko jedną z form wpływu na proces, a nie pełnym opisem problemu.

To także dobry moment, żeby przestać myśleć o guardrails jak o magicznej odpowiedzi na wszystko. AWS oferuje Guardrails, w tym filtry prompt attack, content filters, denied topics i mechanizmy ochrony danych w promptach oraz odpowiedziach. To ważne warstwy ochrony, ale one nie zmieniają podstawowego faktu: filtr wejścia nie zastąpi kontroli możliwości wykonawczych. Nawet dobrze skonfigurowany guardrail nie naprawi architektury, w której agent ma za dużo uprawnień i za szeroki dostęp do narzędzi.

To jest zresztą ten sam wzór, który wraca dziś w innych obszarach security. W Contagious Interview nie chodziło przecież wyłącznie o złośliwy pakiet czy repozytorium. Chodziło o to, że developer działał w zaufanym workflow, używał legalnych narzędzi i wykonywał kroki zgodne ze swoją rolą. Tutaj jest podobnie. Agent AI też nie „robi czegoś dziwnego” w klasycznym sensie. On robi dokładnie to, do czego został zaprojektowany: czyta kontekst, interpretuje go, korzysta z narzędzi, przechodzi do wykonania. Problem zaczyna się wtedy, gdy granica między treścią do analizy a instrukcją do wykonania przestaje być wystarczająco wyraźna.

Dlatego najlepsze pytanie dla security teamów nie brzmi dziś: „czy nasz agent jest odporny na prompt injection?”. Lepsze brzmi: „co dokładnie może zrobić nasz agent, jeśli prompt injection jednak zadziała?”. Czy może sięgnąć do systemów wewnętrznych? Czy ma uprawnienia do modyfikacji workflow? Czy może pisać do logów, zmieniać konfigurację, odpalać narzędzia, wykonywać akcje na danych klientów? Bo właśnie tam zaczyna się prawdziwy impact.

W praktyce oznacza to dość starą, ale dziś bardzo aktualną zasadę: least privilege wraca do centrum. Agent nie powinien dostawać dostępu „na zapas”. Nie powinien móc więcej tylko dlatego, że architektonicznie to wygodne. Jeśli ma czytać, niech nie wykonuje. Jeśli ma analizować, niech nie zmienia konfiguracji. Jeśli ma korzystać z narzędzia, niech korzysta przez jasno ograniczony interfejs, a nie przez szerokie uprawnienia do połowy środowiska. AWS wprost rekomenduje ochronę agentów przy użyciu guardrails i technik ograniczających skutki prompt injection, ale sens tych zaleceń ujawnia się dopiero wtedy, gdy połączysz je z twardą polityką uprawnień.

Z tej perspektywy najciekawsza lekcja z Bedrock nie brzmi: „prompt injection nadal jest groźny”. To wiemy od dawna. Ciekawsza lekcja brzmi: agent AI to nie tylko powierzchnia interpretacji, ale też powierzchnia uprawnień. A kiedy obie te warstwy spotykają się w jednym systemie, bezpieczeństwo przestaje być wyłącznie problemem filtrów treści. Staje się problemem architektury wykonania.

To właśnie dlatego hasło „permission injection” może być użyteczne. Nie jako nowa oficjalna kategoria ataku, ale jako rama myślenia. Przypomina, że sam wpływ na model jest jeszcze niepełnym opisem ryzyka. Pełny obraz pojawia się dopiero wtedy, gdy zapytamy o uprawnienia, integracje, kolejność wykonania, poziom zaufania i możliwość przejścia od interpretacji do działania. Właśnie tam dziś rozgrywa się bezpieczeństwo agentów.

Podsumowanie?

Prompt injection to często tylko wejście.

Prawdziwy problem zaczyna się wtedy, gdy agent ma czym odpowiedzieć światu.

Nie tylko słowem, ale też działaniem.

Źródła

- The Hacker News — We Found Eight Attack Vectors Inside AWS Bedrock. Here’s What Attackers Can Do with Them (23 marca 2026). Materiał opisuje osiem wektorów ataku wokół AWS Bedrock, w tym m.in. agent hijacking, flow injection i guardrail degradation.

- AWS Documentation — Prompt injection security – Amazon Bedrock. Oficjalna dokumentacja AWS o ochronie agentów i aplikacji przed prompt injection, z naciskiem na projektowanie aplikacji, separację instrukcji i bezpieczne użycie agentów.

- AWS Documentation — Detect prompt attacks with Amazon Bedrock Guardrails. Opis filtrów prompt attack w Guardrails oraz sposobu ich konfiguracji.

- AWS Documentation — Amazon Bedrock Guardrails oraz How Amazon Bedrock Guardrails works. Dokumentacja wyjaśniająca, jak Guardrails oceniają wejścia i odpowiedzi modelu oraz jakie warstwy zabezpieczeń można wdrożyć.

- AWS Documentation — Security, Guardrails, and Observability in Amazon Bedrock. Materiał o modelu współdzielonej odpowiedzialności i bezpieczeństwie środowisk budowanych na Bedrock.