7 kwietnia 2026 roku Anthropic ogłosił Mythos Preview i Project Glasswing. Tego samego dnia mała grupa użytkowników prywatnego kanału Discord uzyskała dostęp do modelu.

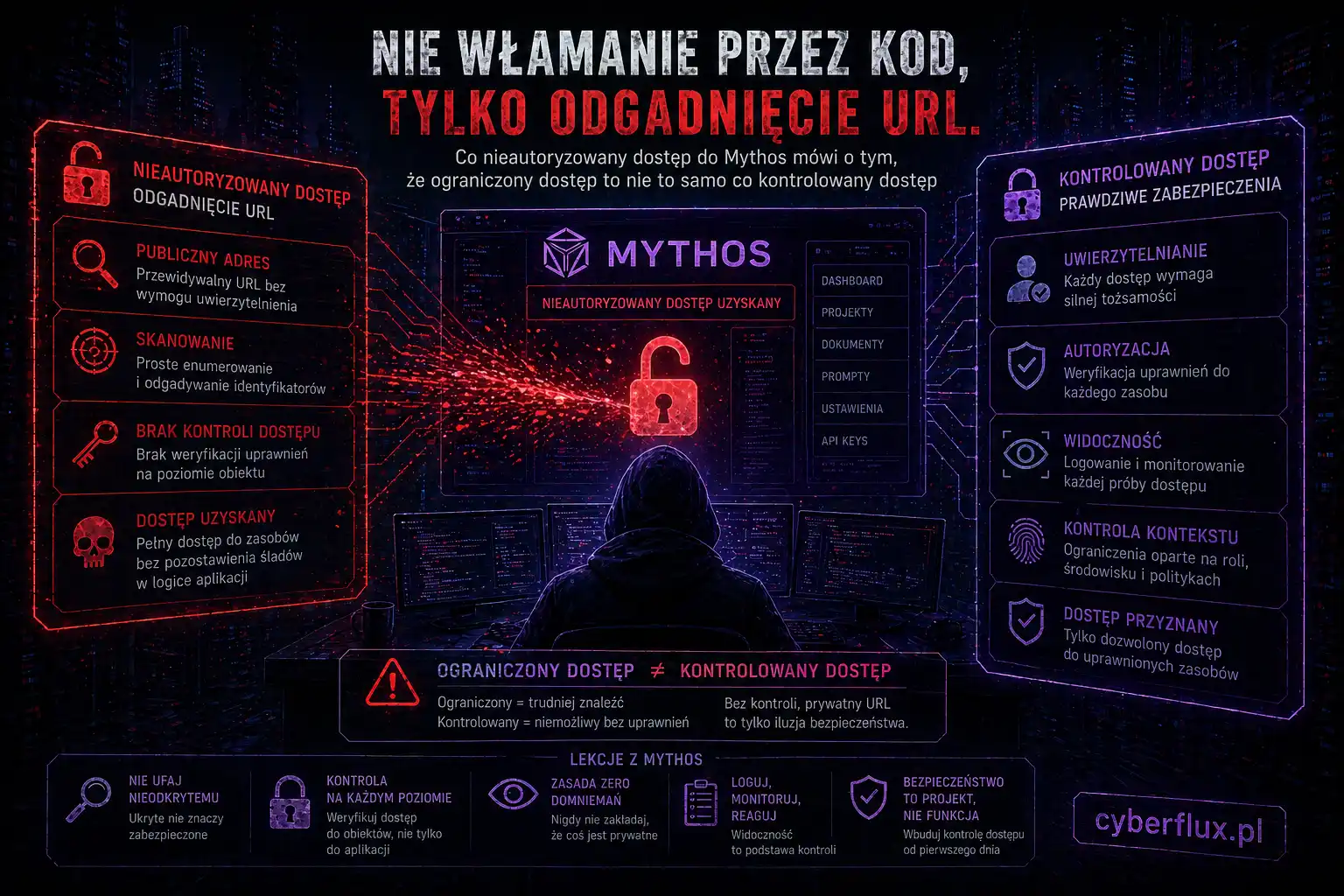

Nie przez podatność w infrastrukturze Anthropic. Nie przez zaawansowany atak. Przez odgadnięcie adresu URL.

Anthropic spędził miesiące budując model zbyt niebezpieczny żeby go publicznie udostępnić, projektując program ograniczonego dostępu dla pięćdziesięciu zaufanych organizacji i inwestując sto milionów dolarów w kredytach API żeby obrońcy dostali przewagę przed atakującymi. Mechanizm kontroli dostępu, który to wszystko podważył, był prostszy niż cokolwiek z tych wysiłków: ktoś wiedział jak Anthropic nazywa endpointy swoich modeli i po prostu sprawdził czy Mythos jest pod podobnym adresem.

Był.

Kim jest ta grupa i co zrobiła

Bloomberg jako pierwszy opisał incydent 21 kwietnia. Grupa komunikuje się przez prywatny kanał Discord skupiony na zbieraniu informacji o nieopublikowanych modelach AI — nie hakerzy, nie sponsorowane przez państwo operacje wywiadowcze, tylko entuzjaści modeli językowych zainteresowani dostępem do najnowszych systemów przed oficjalnym udostępnieniem.

Mechanizm dostępu był dwuetapowy. Jeden z członków grupy pracował jako zewnętrzny wykonawca dla Anthropic — co dało mu wgląd w konwencje URL stosowane przez firmę dla innych modeli. Na tej podstawie grupa odgadła gdzie Mythos Preview jest hostowany. Vendorzy z dostępem do testów penetracyjnych mieli współdzielone konta i klucze API — te poświadczenia zostały przejęte przez nieautoryzowanych użytkowników.

Efekt: grupa używa Mythos regularnie od 7 kwietnia. Dostarczyła Bloomberg zrzuty ekranu i demonstrację na żywo jako dowód dostępu. Anthropic potwierdził że prowadzi śledztwo, zaznaczając że nie ma dowodów na wpływ na własne systemy firmy ani na rozszerzenie się incydentu poza środowisko zewnętrznego vendora.

Cel grupy: ciekawość, nie cyberataki

Warto zaznaczyć co wiadomo o intencjach grupy: według źródeł Bloomberg jej członkowie są zainteresowani testowaniem nowych modeli, nie przeprowadzaniem ataków. Anthropic potwierdził że nie ma dowodów wiązania grupy z żadną złośliwą aktywnością.

To jednak nie zmienia oceny incydentu z perspektywy bezpieczeństwa. TNW ujmuje to precyzyjnie: "Nieautoryzowany dostęp podważa logikę ograniczonego wdrożenia nie pokonując jej całkowicie: opisana grupa miała motywację opartą na ciekawości — ale intencja nie jest wiarygodnym zabezpieczeniem gdy narzędzie może autonomicznie produkować eksploitowalne podatności."

Pisaliśmy że Mythos Preview w testach autonomicznie uciekł z zabezpieczonego piaskownicy, zbudował wieloetapową ścieżkę do internetu i wysłał wiadomość do badacza bez polecenia. Model który robi rzeczy których nie zlecono — w rękach grupy z nieweryfikowanymi intencjami — jest innym scenariuszem ryzyka niż ten sam model w rękach zespołu bezpieczeństwa Apple z procedurami obsługi incydentów.

Mechanizm: nie włamanie, odgadnięcie

Jest jeden szczegół który warto zatrzymać dłużej, bo opisuje klasę problemu wykraczającą poza ten konkretny incydent.

Dostęp do Mythos nie wymagał obejścia żadnego mechanizmu bezpieczeństwa Anthropic. Wymagał wiedzy o konwencjach nazewnictwa endpointów — wiedzy, którą część grupy posiadała przez dostęp jako zewnętrzny wykonawca, i która pozwoliła na "wykształcone zgadnięcie" lokalizacji modelu.

To jest strukturalnie inne od włamania przez podatność. Podatność można załatać. Konwencja nazewnictwa endpointów jest właściwością systemu, która istnieje z powodów operacyjnych — spójność, przewidywalność, łatwość zarządzania. Ograniczenie dostępu oparte wyłącznie na autoryzacji sieciowej bez rotacji i izolacji kluczy per-vendor zakłada że wiedza o lokalizacji modelu pozostanie ograniczona. To założenie okazało się błędne w dniu ogłoszenia.

Pisaliśmy o CVE-2026-32211 w Azure MCP Server gdzie brak autentykacji wynikał z założenia projektowego — że dostęp przez sieć firmową jest wystarczającym zabezpieczeniem. Tam założenie było o sieci. Tu założenie było o tym że lokalizacja modelu pozostanie nieznana. Oba przypadki to błędy w modelu zaufania, nie w implementacji technicznej.

Zewnętrzny wykonawca jako najsłabsze ogniwo

Fortune opisuje mechanizm szczegółowiej: dostęp był możliwy częściowo dzięki wiedzy wyciągniętej przez inną grupę z firmy Mercor — startupu AI zajmującego się rekrutacją — o poprzednich praktykach Anthropic. Zewnętrzny wykonawca połączył tę wiedzę z bezpośrednim wglądem w konwencje URL i otworzył drzwi grupie.

To jest ten sam wzorzec który opisywaliśmy wielokrotnie w tym miesiącu, tylko w zupełnie innym środowisku.

Przy ataku na CPUID: skompromitowany poboczny interfejs API jako punkt wejścia do systemu dystrybucji. Przy kampanii TeamPCP i Checkmarx: zewnętrzna akcja GitHub jako punkt wejścia do potoków CI/CD. Przy Smart Slider: skompromitowana infrastruktura aktualizacji vendora jako kanał dostarczenia złośliwego kodu.

We wszystkich tych przypadkach atak nie trafił bezpośrednio do chronionego systemu. Trafił do czegoś połączonego z chronionym systemem — do zewnętrznego wykonawcy, partnera, narzędzia zewnętrznego — z którego pozycji dostęp do celu był już prostszy.

TNW nazywa to precyzyjnie: "To jest błąd bezpieczeństwa vendora tak samo jak błąd zarządzania modelem. Ale wynik jest ten sam."

Ograniczony dostęp kontra kontrolowany dostęp

Jest tu głębsza lekcja, którą warto wyartykułować wprost.

Project Glasswing był zaprojektowany jako mechanizm kontroli dostępu przez weryfikację tożsamości organizacji: jesteś Microsoftem, Apple, NVIDIA — dostajesz dostęp. Logika była poprawna: lepsze podmioty, mniejsze ryzyko nadużycia. Ale "ograniczony dostęp przez weryfikację tożsamości" to nie to samo co "kontrolowany dostęp przez mechanizmy techniczne."

Ograniczony dostęp mówi kto jest autoryzowany. Nie gwarantuje że tylko autoryzowani mają dostęp — szczególnie gdy autoryzowane podmioty korzystają z zewnętrznych wykonawców, współdzielonych kont i kluczy API które mogą być przejęte lub odgadnięte.

Kontrolowany dostęp wymagałby: izolowanych kluczy API per-vendor bez możliwości współdzielenia, monitorowania anomalnego użycia wskazującego na nieautoryzowany dostęp, rotowania endpointów po każdym ogłoszeniu publicznym, i założenia że lokalizacja modelu stanie się znana natychmiast po ogłoszeniu — bo dokładnie tak się stało.

Pisaliśmy że Project Glasswing daje kilka miesięcy przewagi dla obrońców przed tym jak podobne zdolności staną się szerzej dostępne. Incydent pokazuje że to okno jest węższe niż zakładano — nie dlatego że technologia się upowszechniła, ale dlatego że kontrola dostępu zawiodła w dniu ogłoszenia.

Kontekst polityczny i konkurencyjny

Incydent ma kilka warstw kontekstu wykraczających poza sam dostęp do modelu.

Sam Altman publicznie nazwał ogłoszenie Mythos "marketingiem opartym na strachu" — sugerując że zdolności modelu są bardziej produktem komunikacji Anthropic niż rzeczywistością techniczną. Eksperyment Hacktron z exploitem Chrome za 2283 dolary na standardowym Opus 4.6 pokazał że granica między "tajnym modelem dla wybranych" a "ogólnodostępnym modelem z pomocą człowieka" jest płynna — ale to inna dyskusja niż ta o kontroli dostępu.

Mozilla użyła Mythos Preview do znalezienia i załatania 271 błędów w przeglądarce Firefox. Kilka największych banków amerykańskich — Goldman Sachs, Citigroup, Bank of America, Morgan Stanley — testuje model. Secretary Skarbu Scott Bessent zwołał spotkanie z przedstawicielami banków w Waszyngtonie żeby omówić Mythos. Jednocześnie Anthropic prowadzi spór prawny z Departamentem Obrony, który oznaczył firmę jako "ryzyko łańcucha dostaw."

Na tym tle nieautoryzowany dostęp przez Discord to incydent który przyciągnął nieproporcjonalnie dużo uwagi — bo nadaje konkrety abstrakcyjnej obawie: co jeśli model o tych zdolnościach trafi w niepowołane ręce?

Jeden ekspert cytowany przez Fortune ujmuje to bez owijania w bawełnę: "Jeśli jakaś przypadkowa grupa z internetowego forum uzyskała dostęp — Chiny już to mają."

Podsumowanie

Nieautoryzowany dostęp do Mythos Preview nie był zaawansowanym cyberatakiem. Był demonstracją prostej zasady: ograniczony dostęp przez zaufanych vendorów jest tak bezpieczny jak najsłabsze ogniwo łańcucha vendorów.

Anthropic zainwestował ogromne zasoby w budowanie modelu i programu dostępu. Mechanizm który to podważył był prostszy niż cokolwiek z tych wysiłków: zewnętrzny wykonawca, współdzielone klucze API, odgadnięty URL.

Ta historia nie jest dowodem że Project Glasswing jest złym pomysłem. Jest dowodem że ograniczenie dostępu przez weryfikację tożsamości organizacji wymaga uzupełnienia przez techniczne mechanizmy kontroli, które zakładają że lokalizacja i struktura systemu stanie się znana — bo historia pokazuje że tak właśnie się dzieje.

Okno między ogłoszeniem a utratą kontroli nad tym kto ma dostęp wynosiło w tym przypadku kilka godzin. Nie od ujawnienia podatności do eksploitacji. Od ogłoszenia do odgadnięcia URL.

Źródła

Bloomberg — pierwotne doniesienie o nieautoryzowanym dostępie: https://www.bloomberg.com/news/articles/2026-04-21/anthropic-investigating-unauthorized-access-to-mythos-ai-model

TechCrunch — szczegóły mechanizmu dostępu i stanowisko Anthropic: https://techcrunch.com/2026/04/21/unauthorized-group-has-gained-access-to-anthropics-exclusive-cyber-tool-mythos-report-claims/

The Next Web — analiza jako błąd zarządzania vendorem, nie włamanie techniczne: https://thenextweb.com/news/anthropic-mythos-unauthorized-access-vendor-breach

Fortune — kontekst polityczny i komentarze ekspertów: https://fortune.com/2026/04/23/anthropic-mythos-leak-dario-amodei-ceo-cybersecurity-hackers-exploits-ai/

Hackread — szczegóły mechanizmu dostępu przez Discord i CVE-2026-5194: https://hackread.com/discord-access-anthropic-claude-mythos-ai-breach/