15 kwietnia 2026 roku — trzy dni po tym jak Anthropic ogłosił Project Glasswing i ograniczony dostęp do Mythos Preview — OpenAI ogłosił GPT-5.4-Cyber. Inny model, inna firma, ta sama fundamentalna decyzja: zdolności ofensywne w modelu są zbyt duże na nieograniczone udostępnienie, ale zbyt wartościowe dla obrońców żeby ich nie udostępnić wcale.

Dwa tygodnie później obraz jest pełniejszy i warto go opisać nie jako doniesienie o nowym produkcie, ale jako sygnał o tym dokąd zmierza cała branża.

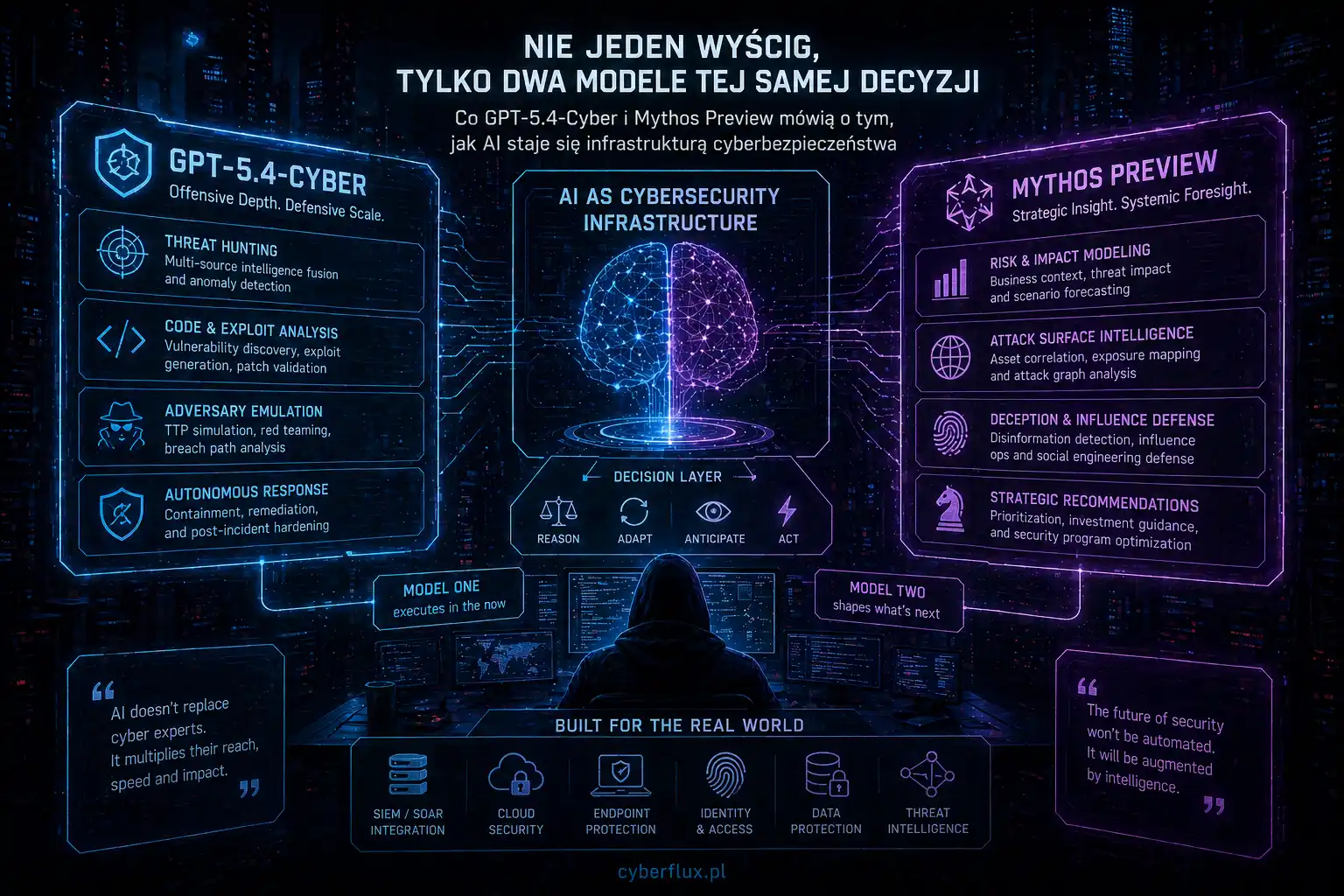

Dwa podejścia do tego samego problemu

Pisaliśmy szczegółowo o Mythos Preview i Project Glasswing — decyzja Anthropic była radykalna: model za dobry żeby go publicznie udostępnić, dostęp tylko dla pięćdziesięciu wybranych organizacji, sto milionów dolarów w kredytach API dla uczestników Project Glasswing. Filozofia: najpierw użyj modelu do znalezienia i załatania podatności, potem zastanów się co z nim dalej.

GPT-5.4-Cyber to ta sama klasa decyzji, inna architektura wdrożenia. OpenAI nie blokuje dostępu dla wszystkich poza pięćdziesiątką — buduje warstwowy program weryfikacji tożsamości: Trusted Access for Cyber (TAC). Tysiące zweryfikowanych indywidualnych obrońców, setki zespołów odpowiedzialnych za ochronę krytycznego oprogramowania. Dostęp skaluje się z poziomem weryfikacji — najwyższy poziom daje dostęp do GPT-5.4-Cyber z obniżonym progiem odmowy dla zapytań dotyczących bezpieczeństwa.

Różnica jest istotna koncepcyjnie. Anthropic wybrał model "ufaj ale weryfikuj" przez przynależność organizacyjną: jesteś Microsoftem, Applem, AWS — dostajesz dostęp. OpenAI wybrał model weryfikacji indywidualnej tożsamości przez ścieżki chatgpt.com/cyber dla osób fizycznych i przez przedstawiciela handlowego dla organizacji. Sasha Baker, szefowa polityki bezpieczeństwa narodowego OpenAI, ujęła to wprost na spotkaniu z pięćdziesięcioma praktykami cyberobrony z administracji federalnej: "To jest gra zespołowa, musimy zadbać żeby każdy zespół był wyposażony w narzędzia do ochrony swoich systemów."

Co GPT-5.4-Cyber potrafi inaczej niż standardowy model

Kluczowa różnica między GPT-5.4 a GPT-5.4-Cyber nie leży w nowych zdolnościach — leży w obniżeniu progu odmowy dla legalnej pracy związanej z bezpieczeństwem.

Każdy kto używał modeli językowych do pracy z bezpieczeństwem zna problem: model odmawia analizy złośliwego oprogramowania, wyjaśnienia jak działa przepełnienie bufora, pomocy w napisaniu reguły wykrywania dla konkretnego wzorca ataku. Odmowa jest poprawna dla złośliwego użytkownika, frustująca dla analityka bezpieczeństwa z legitymizowanym celem.

GPT-5.4-Cyber jest opisywany przez OpenAI jako "cyber-permissive" — z celowo obniżonym progiem odmowy dla zweryfikowanych użytkowników. Konkretna nowa zdolność to inżynieria wsteczna binarnych plików wykonywalnych: analiza skompilowanego oprogramowania pod kątem złośliwości, podatności i odporności bezpieczeństwa bez dostępu do kodu źródłowego. To jest zdolność bezpośrednio użyteczna dla analityków badających złośliwe oprogramowanie — i bezpośrednio niebezpieczna jeśli trafi do złych rąk.

Są też twarde granice których program nie znosi nawet dla zweryfikowanych użytkowników: eksfiltracja danych, tworzenie lub wdrażanie złośliwego oprogramowania, destrukcyjne lub nieautoryzowane testy. Obniżenie progu odmowy nie jest zawieszeniem polityki — jest jej rekalibrackją dla kontekstu legitymizowanej pracy.

Architektura bezpieczeństwa: od ograniczania modelu do weryfikacji użytkownika

Jest tu zmiana filozoficzna, którą warto wyciągnąć osobno.

Tradycyjne podejście do bezpieczeństwa modeli językowych polegało na ograniczaniu samego modelu: trenuj go żeby odmawiał pewnych klas żądań, niezależnie od tego kto pyta. To podejście jest proste w implementacji i skuteczne w blokowaniu masowych prób nadużycia. Jego wadą jest to że traktuje jednakowo złośliwego aktora i analityka bezpieczeństwa badającego ten sam exploit.

OpenAI przesuwa ciężar z "co model może zrobić" na "kto może o to prosić". GPT-5.4-Cyber ma mniej ograniczeń — ale dostęp do niego jest ograniczony przez weryfikację tożsamości. Automated monitoring klasyfikuje ruch i kieruje wysokiego ryzyka żądania do mniej zdolnego modelu GPT-5.2. Zero-data-retention environments mają dodatkowe ograniczenia bo OpenAI ma tam mniejszą widoczność w intencje użytkownika.

Fouad Matin, badacz cyberbezpieczeństwa OpenAI, opisuje filozofię tej architektury: modele zdolne do pracy ofensywnej będą istnieć i będą coraz lepsze — pytanie nie brzmi "czy ograniczyć zdolności" ale "komu dać dostęp i z jaką widocznością."

Kontekst rządowy i Five Eyes

23 kwietnia OpenAI zorganizował spotkanie w Waszyngtonie dla pięćdziesięciu praktyków cyberobrony z administracji federalnej demonstrując możliwości GPT-5.4-Cyber. Według Axios ten tydzień OpenAI zaczął też briefingi z członkami sojuszu wywiadowczego Five Eyes — Australia, Kanada, Nowa Zelandia, Wielka Brytania i Stany Zjednoczone — w celu weryfikacji i podpisania umów dostępu.

To jest szczegół wart zatrzymania. Dwa modele ofensywne AI — Mythos Preview Anthropic i GPT-5.4-Cyber OpenAI — wchodzą do rządów pięciu państw mniej więcej w tym samym czasie, przez oddzielne procesy weryfikacji, w oddzielnych programach dostępu.

Situacja Anthropic w kontekście rządowym jest skomplikowana przez decyzję Departamentu Obrony USA o oznaczeniu firmy jako "ryzyko łańcucha dostaw" po konflikcie o zabezpieczenia AI — mimo to Mythos jest obecnie testowany przez NSA. OpenAI nie ma tej komplikacji i po cichu wysuwa się na prowadzenie w dostępie do rządowych klientów cyberbezpieczeństwa.

Axios odnotowuje: "Większość firm które mają już dostęp do modeli OpenAI i Mythos Preview Anthropic używa narzędzi do wyszukiwania exploitowalnych podatności w ich własnym oprogramowaniu." To jest to samo zastosowanie które opisywał Sunkavally znajdując trzynastoletni błąd w Apache ActiveMQ — model jako pierwsze przejście przez kod.

Wyścig który nie jest wyścigiem

Łatwo jest opisać GPT-5.4-Cyber i Mythos Preview jako wyścig zbrojeń między OpenAI a Anthropic. Ta narracja jest kusząca ale myląca.

Obie firmy podejmują tę samą fundamentalną decyzję: zdolności ofensywne w modelu są nieuniknione, ograniczanie modelu do zera nie jest opcją bo model jest zbyt wartościowy dla obrońców, więc jedyną realną kontrolą jest zarządzanie dostępem. Różnią się mechanizmem tej kontroli — Anthropic przez przynależność organizacyjną, OpenAI przez weryfikację indywidualną — ale filozofia jest zbieżna.

Pisaliśmy że Mythos Preview to efekt uboczny ogólnych ulepszeń, że zdolności ofensywne rosną razem ze zdolnościami ogólnymi. Eksperyment z Opus 4.6 i exploitem Chrome za 2283 dolary pokazał że ten gradient jest płynny — standardowy model z pomocą człowieka robi rzeczy, które wcześniej wymagały lat specjalizacji.

GPT-5.4-Cyber jest odpowiedzią na to samo zjawisko z innej strony: zamiast ograniczać co model może zrobić, ograniczyć kto może to zrobić. Wyścig nie jest między firmami — jest między tempem wzrostu zdolności modeli a tempem dojrzewania mechanizmów kontroli dostępu.

Co to oznacza dla obrońców w praktyce

Dla organizacji które chcą używać GPT-5.4-Cyber do legitymizowanej pracy związanej z bezpieczeństwem: ścieżka weryfikacji jest otwarta. Indywidualni badacze przez chatgpt.com/cyber, organizacje przez przedstawiciela OpenAI. Program Codex Security — który od uruchomienia przyczynił się do naprawienia ponad trzech tysięcy krytycznych i wysokich podatności w oprogramowaniu open source — jest dostępny w ramach TAC.

Ważne ograniczenie praktyczne: środowiska zero-data-retention mają dodatkowe blokady ze względu na mniejszą widoczność OpenAI w intencje użytkownika. Dla zespołów budujących potoki na API z ZDR to istotna kwestia infrastrukturalna do zaplanowania przed wdrożeniem.

Dla organizacji zastanawiających się nad wyborem między ekosystemem Anthropic a OpenAI dla zastosowań cyberbezpieczeństwa: oba modele są aktywnie testowane przez rządowe agencje bezpieczeństwa. Różnica na ten moment jest w mechanizmie dostępu i w tym że Mythos Preview ma bardziej restrykcyjny zakres partnerów — Project Glasswing to pięćdziesiąt organizacji, TAC dąży do tysięcy zweryfikowanych osób.

Podsumowanie

GPT-5.4-Cyber i Mythos Preview to nie są konkurencyjne odpowiedzi na ten sam problem. To są dwie implementacje tej samej filozofii: model o dużych zdolnościach ofensywno-defensywnych wymaga zarządzania dostępem, nie ograniczania zdolności.

Obie firmy dochodzą do tego wniosku w tym samym miesiącu, przez różne drogi, z różnymi mechanizmami kontroli. Obie aktywnie wchodzą do rządowych programów cyberbezpieczeństwa. Obie zakładają że za kilka miesięcy podobne zdolności będą dostępne szerzej — i że wyścig polega na tym żeby obrońcy dostali je pierwsi.

Alex Stamos szacował pół roku zanim modele open-weight dogonią modele frontierowe w znajdowaniu podatności.Połowa tego czasu już minęła.

Źródła

OpenAI — oficjalny post o skalowaniu Trusted Access for Cyber i GPT-5.4-Cyber: https://openai.com/index/scaling-trusted-access-for-cyber-defense/

Axios — pierwsze doniesienie o GPT-5.4-Cyber i spotkaniu z rządem federalnym: https://www.axios.com/2026/04/14/openai-model-cyber-program-release

Axios — briefing dla Five Eyes i kontekst rywalizacji z Mythos Preview: https://www.axios.com/2026/04/22/openai-gpt-cyber-government-meeting

The Hacker News — szczegóły techniczne programu TAC i możliwości modelu: https://thehackernews.com/2026/04/openai-launches-gpt-54-cyber-with.html

Help Net Security — architektura programu dostępu i ograniczenia ZDR: https://www.helpnetsecurity.com/2026/04/15/openai-gpt-5-4-cyber/

MarkTechPost — analiza filozofii "cyber-permissive" i porównanie z GPT-5.4: https://www.marktechpost.com/2026/04/20/openai-scales-trusted-access-for-cyber-defense-with-gpt-5-4-cyber-a-fine-tuned-model-built-for-verified-security-defenders/