Infrastruktura AI na linii frontu

Cyberflux Radar to miesięczny przegląd sygnałów, które pokazują, jak zmienia się krajobraz cyberzagrożeń. Nie jest to lista newsów. To redakcyjna selekcja trendów, scenariuszy i ryzyk, które mogą mieć praktyczne znaczenie dla firm, zespołów IT, developerów i osób odpowiedzialnych za bezpieczeństwo.

W kwietniu 2026 roku najważniejszy sygnał był wyjątkowo wyraźny: AI przestała być tylko dodatkiem do produktów i narzędzi. Coraz częściej staje się warstwą infrastruktury, przez którą przepływają dane, decyzje, automatyzacje i uprawnienia.

A to oznacza, że błędnie zaprojektowany agent, nadmierne uprawnienia, brak kontroli nad integracjami albo zbyt duże zaufanie do automatyzacji mogą stać się nie tylko problemem technologicznym, ale realnym incydentem bezpieczeństwa.

Teza miesiąca

AI przestaje być aplikacją. Staje się powierzchnią ataku.

Przez ostatnie miesiące firmy oswajały się z AI głównie jako narzędziem produktywności: chatbotem, asystentem, funkcją w edytorze tekstu, dodatkiem do CRM-u, narzędziem dla programistów albo wsparciem dla obsługi klienta.

Kwiecień 2026 pokazał jednak coś ważniejszego: AI coraz częściej działa bliżej procesów, danych i infrastruktury.

To zmienia charakter ryzyka.

Problemem nie jest już tylko to, że pracownik wklei poufne dane do publicznego narzędzia AI. Problemem zaczyna być również to, że agent AI może dostać dostęp do repozytorium, systemu zgłoszeń, panelu administracyjnego, skrzynki mailowej, dokumentów, narzędzi DevOps albo środowiska produkcyjnego.

W takim świecie pytanie nie brzmi już:

Czy firma używa AI?

Prawdziwe pytanie brzmi:

Do czego AI ma dostęp, jakie akcje może wykonać i kto to kontroluje?

5 sygnałów Cyberflux

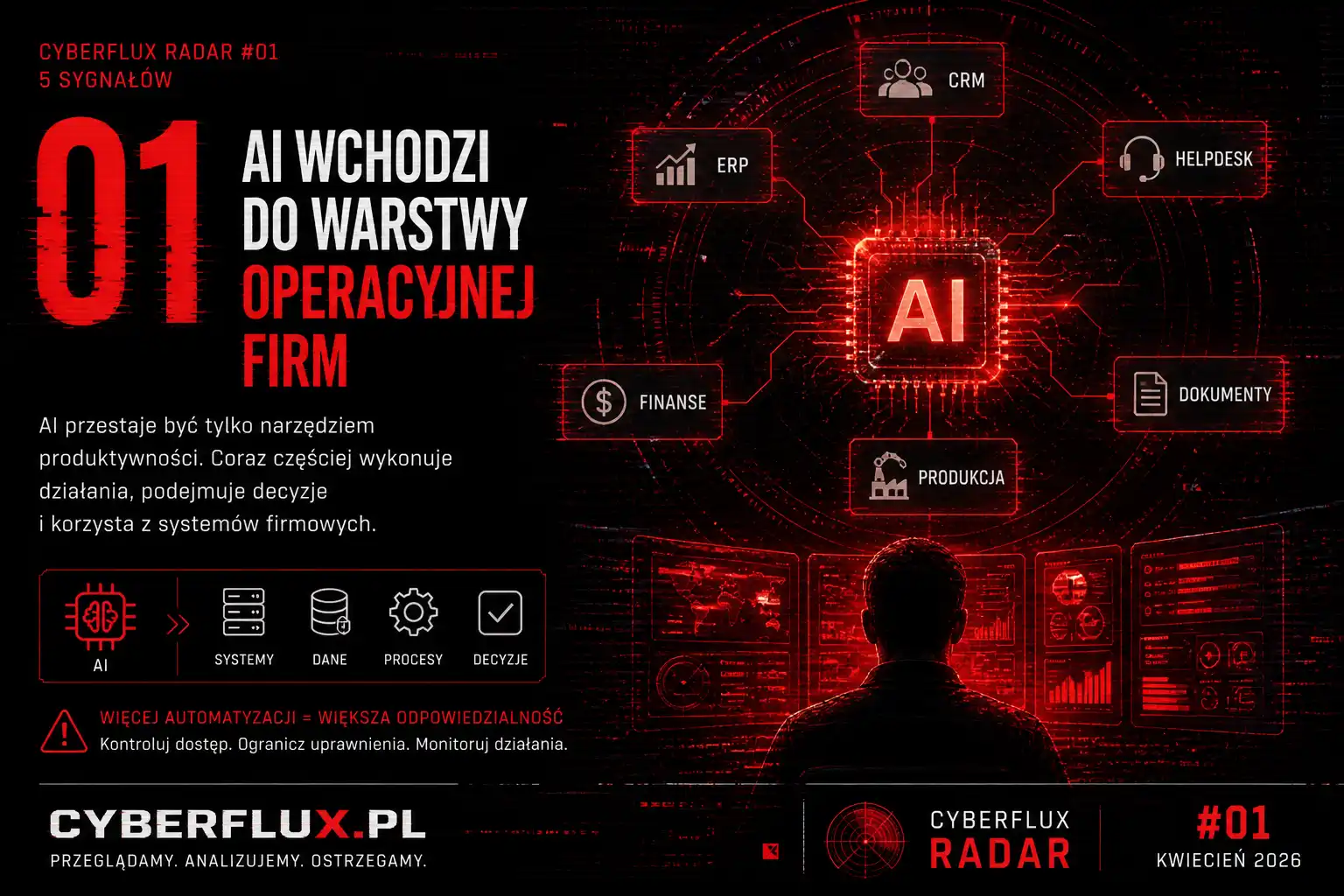

1. AI wchodzi do warstwy operacyjnej firm

Pierwszy sygnał jest najważniejszy: AI coraz częściej nie tylko odpowiada na pytania, ale wykonuje działania.

Może streszczać dokumenty, tworzyć kod, analizować zgłoszenia, klasyfikować incydenty, generować odpowiedzi do klientów, przeszukiwać bazy wiedzy, korzystać z API, integrować się z narzędziami SaaS i wspierać procesy biznesowe.

To wygodne, ale tworzy nowy typ ryzyka: ryzyko operacyjne związane z automatyzacją.

Jeżeli agent AI działa tylko jako doradca, skala szkody jest ograniczona. Jeżeli jednak może podejmować działania w systemach firmowych, zmieniać dane, uruchamiać procesy albo korzystać z uprawnień użytkownika, wtedy błąd konfiguracji może mieć skutki podobne do błędu człowieka z wysokimi uprawnieniami.

Co to oznacza dla firm?

AI trzeba traktować jak nową klasę konta technicznego. Nie jako „inteligentną funkcję”, ale jako komponent z dostępem, uprawnieniami, logami, ograniczeniami i odpowiedzialnością.

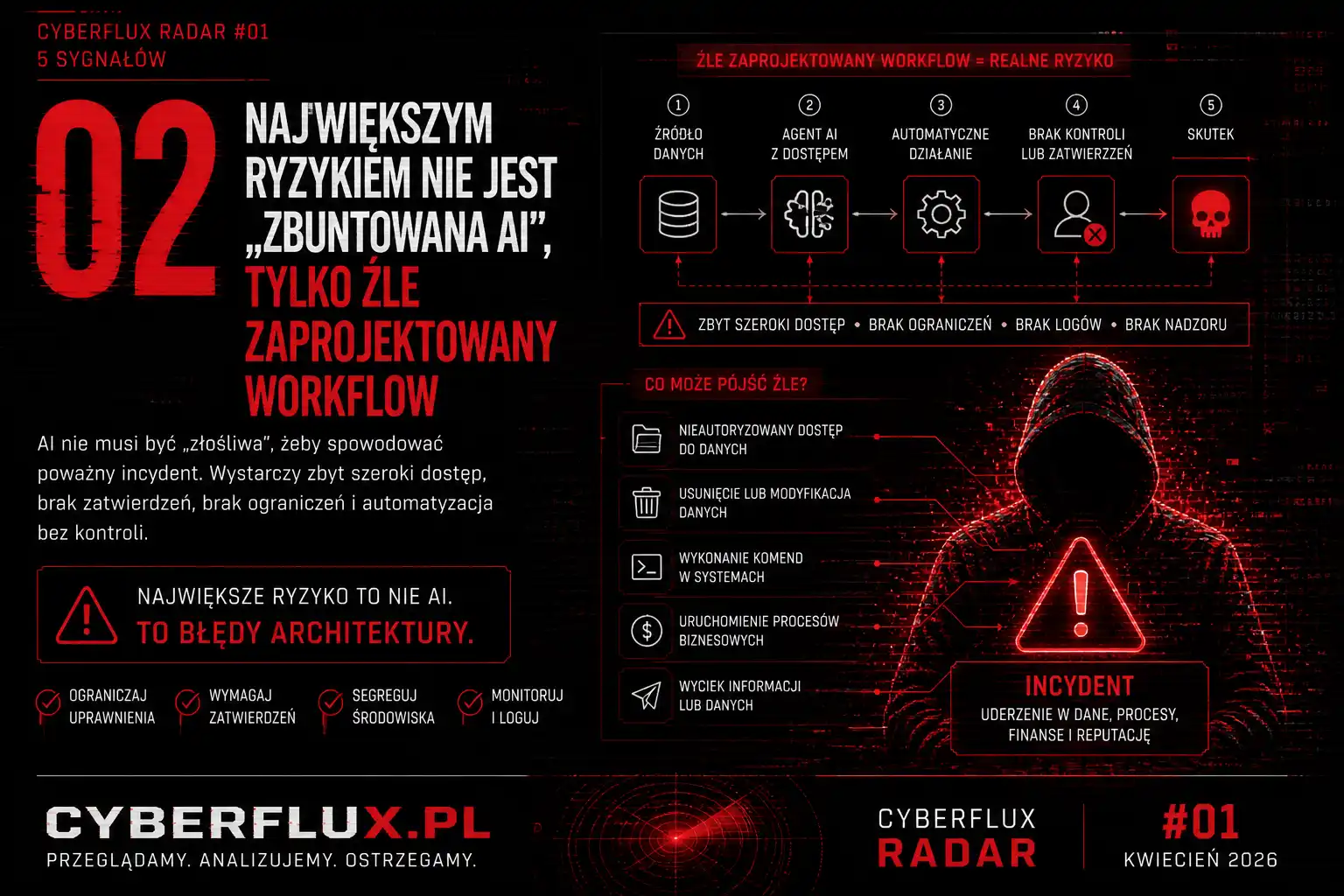

2. Największym ryzykiem nie jest „zbuntowana AI”, tylko źle zaprojektowany workflow

Debata o bezpieczeństwie AI często skupia się na bardzo medialnych scenariuszach: autonomiczne systemy, niekontrolowane modele, sztuczna inteligencja wymykająca się spod kontroli.

W praktyce bliższe ryzyko jest bardziej przyziemne.

To źle zaprojektowany proces.

Agent AI nie musi być „złośliwy”, żeby spowodować problem. Wystarczy, że:

- ma zbyt szerokie uprawnienia,

- działa na produkcyjnych danych,

- wykonuje akcje bez zatwierdzenia człowieka,

- nie ma ograniczeń kontekstowych,

- korzysta z podatnej integracji,

- nie zostawia wystarczających logów,

- nie rozróżnia środowiska testowego i produkcyjnego.

To oznacza, że bezpieczeństwo AI nie zaczyna się od wielkich pytań filozoficznych. Zaczyna się od zwykłej architektury dostępu.

Najważniejsza zasada:

AI nie powinno mieć większych uprawnień niż są absolutnie potrzebne do wykonania konkretnego zadania.

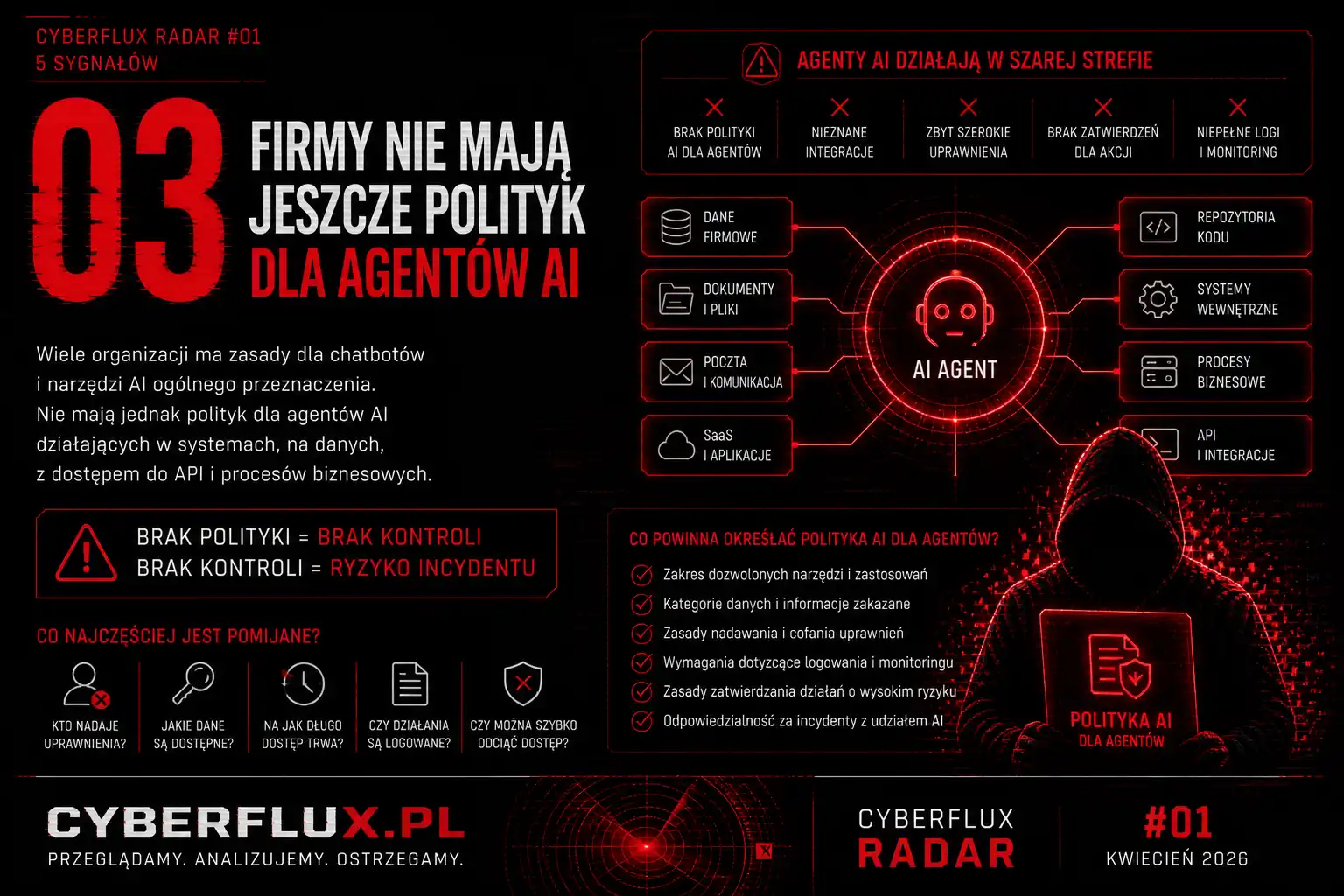

3. Firmy nie mają jeszcze polityk dla agentów AI

Wiele organizacji zaczęło już tworzyć zasady używania narzędzi AI przez pracowników. Często są to proste polityki: czego nie wklejać, jakich danych nie używać, z których narzędzi można korzystać.

To dobry początek, ale niewystarczający.

Nowy problem dotyczy nie tylko ludzi używających AI, ale także AI używającej firmowych systemów.

To wymaga innych pytań:

- Czy agent AI ma osobne konto?

- Kto nadaje mu uprawnienia?

- Czy dostęp jest ograniczony czasowo?

- Czy agent może działać na danych produkcyjnych?

- Czy jego działania są logowane?

- Czy człowiek zatwierdza operacje wysokiego ryzyka?

- Czy można szybko odciąć dostęp agenta?

- Czy firma wie, z jakich integracji AI korzysta?

Jeżeli odpowiedź brzmi „nie wiemy”, to firma prawdopodobnie nie ma polityki bezpieczeństwa AI. Ma jedynie ogólną politykę korzystania z chatbotów.

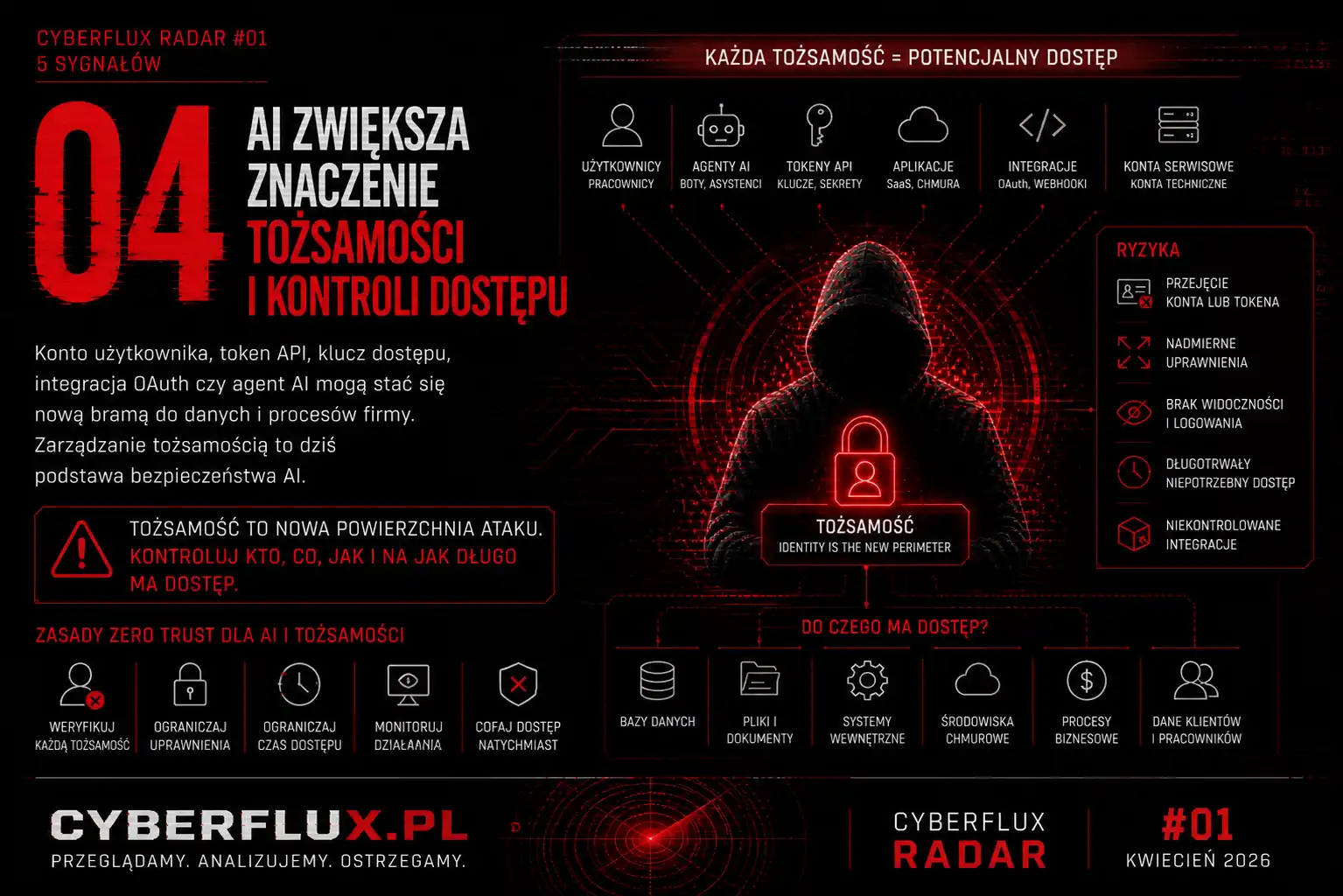

4. AI zwiększa znaczenie tożsamości i kontroli dostępu

W tradycyjnym modelu bezpieczeństwa dużo uwagi poświęcano urządzeniom, sieciom, serwerom i aplikacjom. W modelu opartym na SaaS i AI coraz ważniejsza staje się tożsamość.

Konto użytkownika, token API, klucz dostępowy, integracja OAuth, konto serwisowe albo agent AI mogą stać się bramą do danych i procesów.

Dlatego bezpieczeństwo AI jest mocno powiązane z bezpieczeństwem tożsamości.

Najważniejsze pytania dla zespołów IT i bezpieczeństwa:

- kto lub co ma dostęp do danych,

- przez jaki kanał,

- na jak długo,

- z jakim zakresem uprawnień,

- czy ten dostęp jest monitorowany,

- czy można go natychmiast cofnąć.

AI nie zmniejsza znaczenia IAM, MFA, logów i segmentacji dostępu. Przeciwnie — sprawia, że te elementy stają się jeszcze ważniejsze.

5. Pracownicy będą używać AI szybciej, niż firmy zdążą to uregulować

Ostatni sygnał dotyczy tempa adopcji.

Narzędzia AI są zbyt wygodne, żeby firmy mogły liczyć na to, że pracownicy będą czekać na formalne procedury. Ludzie będą używać AI do pisania maili, analizy dokumentów, tłumaczeń, kodowania, obsługi klientów, tworzenia ofert, researchu i automatyzacji własnej pracy.

Jeżeli firma nie da jasnych zasad i bezpiecznych narzędzi, powstanie shadow AI — niekontrolowane, oddolne użycie narzędzi AI poza wiedzą IT.

To może prowadzić do wycieków danych, naruszeń poufności, błędów decyzyjnych, problemów prawnych i utraty kontroli nad tym, gdzie trafiają informacje firmowe.

Najgorszą strategią jest udawanie, że problemu nie ma.

Lepsza strategia to szybkie minimum:

- lista dozwolonych narzędzi,

- zakaz używania określonych kategorii danych,

- zasady dla danych klientów,

- polityka dla kodu źródłowego,

- zasady dla integracji AI z systemami firmowymi,

- ścieżka akceptacji dla nowych narzędzi.

Cyberflux Signal Score — kwiecień 2026

Poniższa ocena nie jest statystyką rynku. To redakcyjna ocena Cyberflux oparta na obserwowanych sygnałach, potencjalnym wpływie na organizacje i pilności działań obronnych.

| Sygnał | Prawdopodobieństwo | Wpływ | Pilność | Ocena |

|---|---|---|---|---|

| Shadow AI w firmach | 5/5 | 4/5 | 5/5 | Krytyczne |

| Nadmierne uprawnienia agentów AI | 4/5 | 5/5 | 5/5 | Krytyczne |

| Brak logowania działań AI | 4/5 | 4/5 | 4/5 | Wysokie |

| Wklejanie danych firmowych do narzędzi AI | 5/5 | 3/5 | 4/5 | Wysokie |

| Integracje AI z SaaS bez kontroli IT | 4/5 | 5/5 | 4/5 | Wysokie |

| Brak polityki AI dla pracowników | 5/5 | 3/5 | 5/5 | Wysokie |

| Prompt injection i manipulacja kontekstem | 3/5 | 4/5 | 3/5 | Średnie/Wysokie |

Najważniejszy wniosek: firmy powinny traktować AI nie jako osobny eksperyment technologiczny, ale jako część zarządzania dostępem, danymi i procesami.

Scenariusz miesiąca

Agent AI z dostępem do systemów firmowych

Wyobraźmy sobie firmę, która wdraża agenta AI do obsługi zgłoszeń technicznych. Agent ma analizować tickety, przeszukiwać bazę wiedzy, sugerować odpowiedzi i wykonywać proste działania administracyjne.

Na początku działa świetnie. Skraca czas obsługi, odciąża zespół, pomaga klasyfikować zgłoszenia.

Problem zaczyna się wtedy, gdy agent otrzymuje zbyt szerokie uprawnienia.

Może przeglądać dane klientów, korzystać z historii zgłoszeń, mieć dostęp do panelu SaaS, wykonywać akcje na kontach użytkowników, a czasem także korzystać z integracji, których nikt dokładnie nie przejrzał.

W takim scenariuszu incydent nie musi wyglądać jak klasyczny atak hakerski.

Wystarczy, że:

- użytkownik wprowadzi złośliwą instrukcję w zgłoszeniu,

- agent źle zinterpretuje kontekst,

- integracja pozwoli wykonać zbyt szeroką akcję,

- zabraknie zatwierdzenia człowieka,

- nikt nie zauważy nietypowego działania, bo logi są niepełne.

Efekt? Dane mogą zostać ujawnione, konta błędnie zmodyfikowane, procesy uruchomione bez zgody, a firma może mieć trudność z odtworzeniem, co dokładnie się wydarzyło.

To pokazuje sedno problemu: AI nie musi być przeciwnikiem. Wystarczy, że stanie się niekontrolowanym pośrednikiem między człowiekiem a systemem.

Kogo to dotyczy?

|

Grupa |

Najważniejsze ryzyko |

Co sprawdzić |

|---|---|---|

|

Zarząd |

brak kontroli nad użyciem AI w firmie |

czy istnieje polityka AI i właściciel tematu |

|

IT/Admin |

niekontrolowane integracje i konta techniczne |

kto/co ma dostęp do systemów i API |

|

Security |

brak logowania działań AI |

czy działania agentów są widoczne w logach |

|

Developerzy |

użycie AI przy kodzie i repozytoriach |

czy kod, tokeny i sekrety nie trafiają do narzędzi AI |

|

HR/Back office |

wklejanie danych osobowych do AI |

jakie dane wolno przetwarzać w narzędziach AI |

|

Legal/Compliance |

ryzyko naruszenia poufności i RODO |

czy AI jest uwzględnione w analizie ryzyka |

|

Product/Operations |

automatyzacje bez nadzoru |

które procesy AI może uruchamiać samodzielnie |

Co firma powinna sprawdzić w 7 dni?

Checklista Cyberflux

- Zrób listę narzędzi AI używanych w firmie.

Nie zaczynaj od polityki. Zacznij od rzeczywistości. Sprawdź, z czego faktycznie korzystają pracownicy. - Oddziel narzędzia do pracy z danymi publicznymi od narzędzi do danych firmowych.

Nie każde AI nadaje się do pracy z dokumentami klientów, kodem źródłowym, danymi finansowymi albo informacjami osobowymi. - Sprawdź, czy agenci AI lub integracje mają osobne konta.

AI nie powinno działać na prywatnym koncie pracownika ani na koncie administratora. - Ogranicz uprawnienia według zasady minimum dostępu.

Agent ma mieć tylko te dostępy, które są potrzebne do konkretnego zadania. - Wyłącz możliwość wykonywania działań wysokiego ryzyka bez zatwierdzenia człowieka.

Dotyczy to zwłaszcza zmian w danych, operacji finansowych, usuwania informacji, modyfikacji kont i działań na środowiskach produkcyjnych. - Sprawdź logowanie działań AI.

Firma powinna wiedzieć, co agent zrobił, kiedy, na czyje żądanie i z jakim skutkiem. - Ustal zasady dla kodu źródłowego i sekretów.

Developerzy powinni wiedzieć, czy mogą używać AI do analizy kodu, a jeśli tak, to w jakim środowisku i z jakimi ograniczeniami. - Zdefiniuj dane zakazane.

Na przykład: dane klientów, dane medyczne, dane finansowe, dane logowania, tokeny, klucze API, tajemnice przedsiębiorstwa, nieopublikowane dokumenty strategiczne. - Dodaj AI do procesu oceny nowych narzędzi SaaS.

Jeżeli narzędzie ma funkcje AI, trzeba sprawdzić, jakie dane przetwarza, gdzie je wysyła, czy trenuje na danych użytkownika i jakie ma integracje. - Wyznacz właściciela tematu AI security.

Bez właściciela temat będzie dryfował między IT, security, legalem, compliance i biznesem.

Minimalna polityka AI dla firmy

Na tym etapie wiele firm nie potrzebuje jeszcze wielkiego dokumentu. Potrzebuje krótkich, jasnych zasad.

Minimalna polityka powinna odpowiedzieć na 7 pytań:

- Z jakich narzędzi AI można korzystać?

- Jakich danych nie wolno wprowadzać do AI?

- Czy można używać AI do kodu źródłowego?

- Czy można podłączać AI do firmowych systemów?

- Kto zatwierdza nowe integracje AI?

- Czy działania agentów AI są logowane?

- Kto odpowiada za incydenty związane z AI?

Jeżeli firma nie zna odpowiedzi na te pytania, to znaczy, że używa AI szybciej, niż potrafi nim zarządzać.

Sygnał dla rynku

Kwiecień 2026 pokazuje, że bezpieczeństwo AI zaczyna przesuwać się z poziomu dyskusji o narzędziach na poziom dyskusji o infrastrukturze.

To ważna zmiana.

Jeszcze niedawno pytano głównie:

Czy pracownicy mogą używać ChatGPT?

Teraz trzeba pytać:

Jakie systemy są połączone z AI, jakie dane przez nie przepływają i jakie działania AI może wykonać bez człowieka?

To oznacza, że AI security przestaje być niszowym tematem dla zespołów eksperymentujących z nowymi technologiami. Staje się częścią podstawowego bezpieczeństwa organizacji: zarządzania tożsamością, dostępem, danymi, logami, procesami i odpowiedzialnością.

Wniosek Cyberflux

Największym ryzykiem AI w firmach nie jest dziś futurystyczny scenariusz, w którym sztuczna inteligencja wymyka się spod kontroli.

Bardziej realne ryzyko jest prostsze:

firma daje narzędziu AI dostęp do danych i procesów, ale nie daje mu granic.

Dlatego najważniejsze działania na najbliższe miesiące to nie wielkie strategie, lecz podstawowa higiena:

- ograniczanie uprawnień,

- kontrola integracji,

- logowanie działań,

- zatwierdzanie operacji wysokiego ryzyka,

- polityka użycia AI,

- edukacja pracowników,

- jasna odpowiedzialność.

AI staje się częścią infrastruktury. A wszystko, co staje się infrastrukturą, musi być projektowane, monitorowane i zabezpieczane jak infrastruktura.

O Cyberflux Radar

Cyberflux Radar to cykliczny przegląd sygnałów cyberbezpieczeństwa przygotowywany przez Cyberflux.pl. Analizujemy wybrane wydarzenia, ostrzeżenia, trendy technologiczne, incydenty i zmiany w sposobach działania atakujących, aby pokazać, które ryzyka wymagają szczególnej uwagi w najbliższym czasie.

Radar nie jest statystycznym badaniem rynku. To ocena trendów i priorytetów, której celem jest pomoc firmom, zespołom IT, developerom i osobom zarządzającym w szybszym rozpoznawaniu zmian w krajobrazie zagrożeń.