John Hultquist, chief analyst Google Threat Intelligence Group, napisał 11 maja 2026 roku jedno zdanie które jest streszczeniem całego raportu: "There's a misconception that the race to AI vulnerabilities is imminent. The reality is it has already started."

I dodał coś ważniejszego: "For every zero-day we can trace back to AI, there are probably many more out there."

GTIG nie ogłosił że za rok lub za dwa lata AI stanie się groźnym narzędziem w rękach atakujących. Ogłosił że już jest — i że to co widzą to fragment większego obrazu, widoczny tylko dlatego że atakujący popełnili błędy których następnym razem mogą nie popełnić.

Trzy odciski palców

GTIG nie powiedział że "wygląda jakby AI to napisało." Powiedział że ma wysoką pewność opierając się na trzech konkretnych technicznych sygnałach w kodzie exploita.

Pierwszym jest obfitość "educational docstrings" — komentarzy w kodzie które krok po kroku tłumaczą co robi każda funkcja. Doświadczony człowiek piszący exploit nie tłumaczy sobie własnego kodu. Modele językowe są trenowane na materiałach edukacyjnych i produkują kod który wygląda jak tutorial nawet gdy pisze coś co ma być orężem ataku.

Drugim jest halucynowany wynik CVSS. Skrypt zawierał ocenę CVSS podatności — liczbę której żadna organizacja standaryzacyjna nie przypisała, bo podatność była nieznana. Model ją wymyślił, bo w jego danych treningowych exploity mają wyniki CVSS. Człowiek piszący zero-day nie wstawia wyniku CVSS bo wie że go nie ma.

Trzecim jest "textbook Pythonic format" — czysta, symetryczna struktura kodu z szczegółowymi menu pomocy i klasą kolorowania terminala. Ludzkie exploity są brzydkie. Piszą je ludzie którzy są skupieni na tym żeby działały, nie na tym żeby były czytelne. LLM produkuje kod który wygląda jak przykład z podręcznika nawet gdy jest bronią.

Te trzy sygnały razem: Google ma "wysoką pewność." W intelligence to jest znaczący próg.

To co jest ważniejsze niż sam incydent

Podatność którą AI odkryło i wyeksploitowało to semantyczny błąd logiczny — deweloper zakodował na stałe założenie zaufania w przepływie uwierzytelnienia, tworząc sprzeczność z logiką wymuszania 2FA. Każde żądanie spełniające pewien warunek było traktowane jako zaufane i omijało drugi składnik.

Tradycyjne skanery bezpieczeństwa szukają krachów, przepełnień buforów, niebezpiecznych wywołań systemowych. Czytają kod mechanicznie. Błąd który znalazło AI nie powoduje krachu. Nie przepełnia bufora. Wygląda "funkcjonalnie poprawnie" dla każdego automatycznego narzędzia które jest dziś w użyciu.

GTIG opisuje to zdaniem które jest centralnym punktem całego raportu: "LLMs excel at identifying these types of high-level flaws and hardcoded static anomalies. Though frontier LLMs struggle to navigate complex enterprise authorization logic, they have an increasing ability to perform contextual reasoning, effectively reading the developer's intent to correlate the 2FA enforcement logic with the contradictions of its hardcoded exceptions. This capability can allow models to surface dormant logic errors that appear functionally correct to traditional scanners but are strategically broken from a security perspective."

Model nie skanował kodu pod kątem znanych wzorców podatności. Czytał intencję dewelopera. Porównał ją z implementacją. Znalazł miejsce gdzie te dwie rzeczy się rozmijają.

To jest strukturalnie nowa klasa odkrywania podatności — nie szybsza wersja tego co robią skanery, ale inny rodzaj rozumowania. I tradycyjne narzędzia bezpieczeństwa nie są zaprojektowane żeby znajdować to co AI znajduje w ten sposób.

Mapa jest szersza niż jeden incydent

GTIG nie opisał jednego incydentu. Opisał ekosystem.

APT45 — Korea Północna wysyła "tysiące powtarzalnych promptów" do modeli AI żeby rekurencyjnie analizować CVE i walidować proof-of-concept exploity. GTIG mówi wprost: budują arsenał exploitów "w skali która byłaby operacyjnie niemożliwa bez AI." To nie jest jeden badacz z subskrypcją. To jest przemysłowa fabryka exploit-ów.

UNC2814 — Chiny używa "persona-driven jailbreak" — promptowania modelu żeby zachowywał się jak starszy audytor bezpieczeństwa wyspecjalizowany w embedded devices — do analizy firmware routerów TP-Link i implementacji protokołu OFTP. Próby obejścia guardrails Gemini przez przyjęcie roli eksperta w konkretnej domenie.

Grupy rosyjskie używają AI do generowania audio wstrzykiwanego do legalnych nagrań informacyjnych. AI nie w atakach technicznych — w operacjach wpływu i dezinformacji.

Backdoory Android używają API Gemini do autonomicznego nawigowania po zainfekowanych urządzeniach — AI jako moduł sterujący złośliwego oprogramowania, nie tylko jako narzędzie do jego napisania.

Malware z wypełniaczem AI — rodziny złośliwego oprogramowania "wypchane" kodem generowanym przez AI specjalnie po to żeby zmylić analityków i automatyczne systemy wykrywania. Nie nowy malware — stary malware obfuskowany przez to że wygląda jak milion innych plików z kodem.

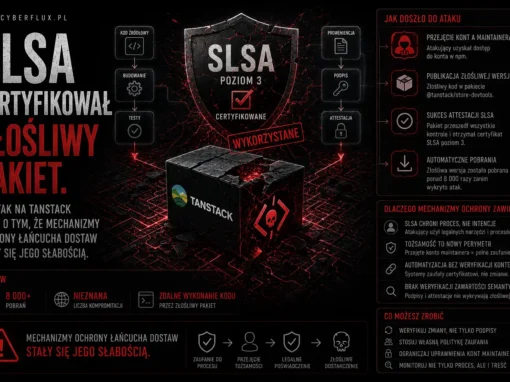

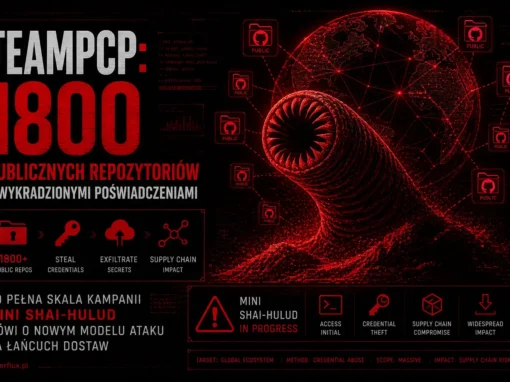

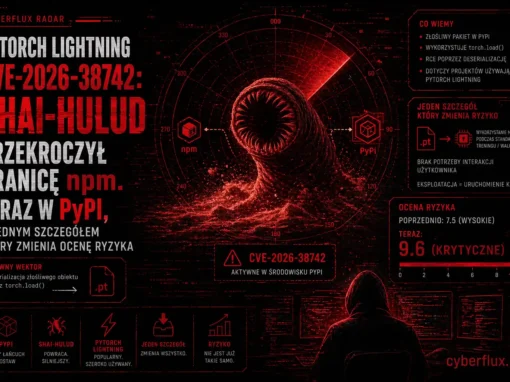

TeamPCP pojawia się w raporcie GTIG jako udokumentowany przykład: kompromitacja LiteLLM przez zatrute pakiety PyPI i złośliwe pull requesty z kradzieżą kluczy AWS i tokenów GitHub, spieniężonymi przez partnerstwa ransomware. GTIG opisuje to jako wzorzec który "staje się standardowy" — atakujący celują w warstwę integracyjną wokół systemów AI, nie w same modele.

Dlaczego clumsy implementation to nie jest pocieszenie

The Register odnotowuje jeden szczegół który jest ważny: błędy w implementacji exploita prawdopodobnie utrudniły atakującym realizację planowanej masowej kampanii. Atak był nieudany nie tylko dlatego że Google go wykrył — był też niedopracowany technicznie.

Hultquist odpowiada na to z rozbrajającą wprost: "Dla każdego zero-daya który możemy powiązać z AI, prawdopodobnie jest ich wiele więcej."

Clumsy implementation tego konkretnego exploita wynikała z tego że atakujący jeszcze uczą się jak optymalnie używać AI do pisania ataków. Za rok będą wiedzieć więcej. Za dwa lata jeszcze więcej. Edukacyjne docstringi i halucynowany CVSS to błędy operacyjne które znikną gdy atakujący nauczą się promptować modele tak żeby produkowały czysty kod bez fingerprints.

Hultquist mówi w raporcie że spodziewa się że aktualizacja GTIG AI Threat Tracker za Q3 2026 "pokaże jak daleko przesunęła się trajektoria możliwości od maja." Nie brzmi jak prognoza niskiego ryzyka.

Paralela z tym co cyberflux opisywał od miesięcy

W kwietniu opisywaliśmy atak na stację wodociągową w Monterrey — Claude który bez wiedzy o protokołach OT poprawnie zidentyfikował bramkę do infrastruktury przemysłowej i opracował plan ataku. AI jako przewodnik dla atakującego który znał IT ale nie znał OT.

Opisywaliśmy eksploit Chrome za 2283 dolary na standardowym Opus 4.6 — badacz bez specjalizacji w exploitach przeglądarkowych, tydzień z pomocą modelu, działający łańcuch exploita.

Opisywaliśmy trzynastoletni błąd w Apache ActiveMQ znaleziony przez Claude — badacz który powiedział "80% Claude, 20% człowieka."

Raport GTIG zamyka tę serię dokumentując ten sam wzorzec po stronie atakujących, bez badacza jako operatora, w realnym ataku z planem masowej eksploitacji.

Pisaliśmy przy okazji raportu Mandiant M-Trends 2026 że mediana time-to-exploit jest ujemna — exploity pojawiają się przed łatkami. GTIG dodaje wymiar który M-Trends nie opisywał: AI nie tylko przyspiesza eksploitację znanych podatności — zaczyna znajdować klasy podatności których tradycyjne narzędzia strukturalnie nie widzą.

Semantyczna logika jako nowy priorytet

GTIG wskazuje jedno praktyczne wnioskowanie dla obrońców: klasy błędów które AI odkrywa — logiczne sprzeczności między intencją a implementacją, hardcoded trust assumptions, dormant logic errors — nie są wykrywane przez narzędzia które mamy. Skanery szukają crashów. LLMy czytają intencję.

To jest konkretny argument za użyciem tych samych narzędzi AI defensywnie — nie żeby zastąpić istniejące skanery, ale żeby pokryć klasę błędów których skanery nie widzą. Google używa własnych narzędzi Big Sleep i CodeMender do tego celu. Organizacje które nie mają dostępu do Mythos Preview mogą używać Opus 4.6 do pierwszego przejścia przez kod pod kątem logicznych sprzeczności w przepływach uwierzytelnienia i autoryzacji.

Project Glasswing z Mythos Preview zakładał przewagę kilku miesięcy dla obrońców przed tym jak podobne zdolności staną się szerzej dostępne. GTIG ogłasza że przewaga nie istnieje już teraz — nie dlatego że obrońcy przegrali, ale dlatego że obydwie strony mają dostęp do tych samych modeli i robią z nimi to co rozumieją.

Podsumowanie

11 maja 2026 roku Google udokumentowało coś o czym branża mówiła jako o przyszłości przez ostatnie dwa lata.

Nie jest to historia o jednym exploicie który AI napisało i Google zablokował. Jest to historia o tym że AI zaczyna znajdować klasy podatności które są niewidoczne dla istniejących narzędzi, że robi to w sposób dostępny dla każdego z dostępem do modelu i sensownym promptem, i że atakujący — od grup cyberprzestępczych przez APT45 po chińskie operacje szpiegowskie — są już w tej grze.

Hultquist ma rację. To już tutaj.

Pytanie nie brzmi kiedy AI stanie się narzędziem ofensywnym. Brzmi ile zero-dayów bez hallucynowanego CVSS i bez edukacyjnych docstringów jest już na wolności — i jak długo zanim zobaczymy kolejny raport który powie że tamte były tylko początkiem.

Źródła

Google Cloud Blog / GTIG — pełny raport AI Threat Tracker z maja 2026: https://cloud.google.com/blog/topics/threat-intelligence/ai-vulnerability-exploitation-initial-access

The Hacker News — szczegóły techniczne exploita i trzy fingerprints LLM: https://thehackernews.com/2026/05/hackers-used-ai-to-develop-first-known.html

SecurityWeek — omówienie z kontekstem raportu: https://www.securityweek.com/google-detects-first-ai-generated-zero-day-exploit/

The Register — analiza clumsy implementation i cytat Hultquista o niewidocznych exploitach: https://www.theregister.com/ai-ml/2026/05/11/google-says-criminals-used-ai-built-zero-day-in-planned-mass-hack-spree/

CSO Online — szczegóły UNC2814, APT45 i klasa semantic logic flaw: https://www.csoonline.com/article/4169046/google-discovers-weaponized-zero-day-exploits-created-with-ai.html

Fortune — "It's here" — cytat Hultquista i kontekst regulacyjny: https://fortune.com/2026/05/11/google-catches-hackers-cybersecurity-warning-ai-anthropic-mythos/

Daily Security Review — analiza trzech fingerprints i implikacje dla narzędzi defensywnych: https://dailysecurityreview.com/cyber-security/google-gtig-documents-first-ai-generated-zero-day-exploit/

Notebookcheck — szczegóły kampanii APT45 i UNC2814: https://www.notebookcheck.net/Google-identifies-first-AI-developed-zero-day-exploit.1294271.0.html

Nie nowy atak, tylko naprawiony błąd. Co łatka Gemini CLI mówi o tym, że tryb –yolo w potoku CI/CD to nie jest dobry pomysł