Nowy raport Oasis Security o „Claudy Day” opisuje łańcuch błędów w Claude, który miał umożliwiać prompt injection, eksfiltrację danych i wykorzystanie open redirectu. To jeszcze nie szeroko potwierdzona kampania, ale bardzo dobry przykład, że prompt injection staje się dziś problemem całej architektury agenta, a nie tylko modelu.

Kilka dni temu pisaliśmy na Cyberflux, że prompt injection przestaje być problemem samego modelu, a staje się problemem architektury zaufania: uprawnień, narzędzi, pamięci i tego, co agent może zrobić po kontakcie z niezaufaną treścią. Nowy raport Oasis Security o łańcuchu nazwanym „Claudy Day” dobrze wpisuje się właśnie w ten kierunek. To nie jest jeszcze historia o szeroko potwierdzonej kampanii, ale o badawczym disclosure, który pokazuje, jak bardzo ryzyko przesuwa się dziś z poziomu pojedynczego promptu na poziom całego workflow.

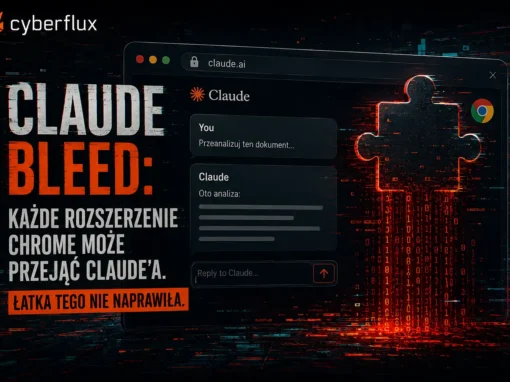

Według Oasis badacze połączyli w Claude trzy elementy w jeden działający łańcuch: niewidoczne prompt injection przenoszone przez parametr URL, możliwość eksfiltracji danych przez Anthropic Files API oraz open redirect na domenie claude.com, który miał pomagać w obejściu części kontroli i zwiększać wiarygodność linku. Oasis twierdzi, że taki scenariusz mógł działać nawet w bardzo podstawowej sesji Claude — bez MCP, bez dodatkowych integracji i bez narzędzi dołączanych przez użytkownika. Dark Reading opisał ten sam research jako pełny łańcuch od dostarczenia ataku do cichej eksfiltracji danych.

To właśnie ten aspekt jest tu najciekawszy. Nie chodzi już o klasyczny obrazek z prompt injection, w którym model odpowiada źle, bo ktoś przemycił w treści złośliwą instrukcję. W opisie Oasis atak zaczyna się od pozornie zwykłego kliknięcia w wynik wyszukiwania, a kończy na przetworzeniu przez model zarówno widocznej, jak i ukrytej części instrukcji oraz przesłaniu danych dalej przez legalny mechanizm platformy. Jeśli ten łańcuch dobrze oddaje zachowanie systemu, to mamy do czynienia nie z „ciekawostką wokół modeli”, ale z praktycznym przykładem tego, że granica bezpieczeństwa przebiega dziś przez cały układ zaufania: wejście, interpretację, wykonanie i egress danych.

I tutaj nowy research bardzo dobrze dopowiada wniosek z naszego wcześniejszego tekstu. Pisaliśmy wtedy, że prawdziwy problem zaczyna się tam, gdzie agent nie tylko czyta świat, ale może w nim działać — przeglądać web, korzystać z pamięci, używać narzędzi i podejmować działania w imieniu użytkownika. „Claudy Day” wygląda właśnie jak przykład takiego przesunięcia: prompt injection przestaje być błędem interpretacji, a staje się problemem integralności całego workflow. Nie dlatego, że model „dał złą odpowiedź”, ale dlatego, że w określonej architekturze może zostać wciągnięty w nieautoryzowane przetwarzanie i transfer danych.

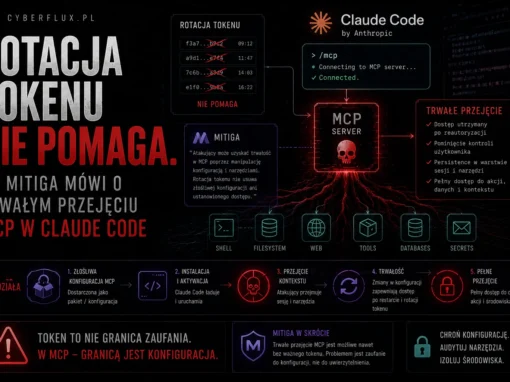

Ważne jest jednak, by nie przeszacować tej historii. Na dziś głównym źródłem technicznych szczegółów pozostaje sam raport Oasis, a Dark Reading jest przede wszystkim opracowaniem tego disclosure. Nie widać jeszcze szeroko opisanej, niezależnie udokumentowanej kampanii ani pełnego zestawu publicznych analiz z wielu źródeł. Z tego powodu uczciwiej jest traktować „Claudy Day” jako sygnał badawczy i przykład kierunku zagrożeń, a nie jako potwierdzenie masowo wykorzystywanego wektora ataku na dużą skalę. Jednocześnie Oasis podaje, że Anthropic miało naprawić flaw związany z prompt injection i pracować nad pozostałymi elementami łańcucha.

Z perspektywy bezpieczeństwa to i tak bardzo cenna lekcja. Jeśli agent ma dostęp do wrażliwego kontekstu, możliwość zapisu lub wysyłki danych i brak mocnych ograniczeń dla działań wykonywanych na pierwszym kroku interakcji, to sam prompt injection jest tylko początkiem problemu. Prawdziwe pytanie brzmi już nie „czy model rozpozna złośliwą instrukcję?”, ale „co może zrobić, jeśli jej nie rozpozna?”. I to właśnie ten sposób myślenia odróżnia dojrzałe podejście do bezpieczeństwa agentów od prób sprowadzania całego tematu do kolejnej wariacji na temat filtrowania promptów.

„Claudy Day” dobrze pokazuje więc coś szerszego niż jeden research o Claude. W 2026 roku prompt injection coraz częściej nie jest już problemem samego modelu, lecz problemem systemów, które przetwarzają niezaufane wejście i jednocześnie mają zdolność działania. To nie musi oznaczać natychmiastowej katastrofy, jeśli architektura ogranicza uprawnienia, wymusza zatwierdzanie ryzykownych akcji i kontroluje ścieżki eksfiltracji. Ale jeśli tych zabezpieczeń brakuje, nawet pozornie banalna manipulacja kontekstem może zacząć przypominać pełnoprawny incydent bezpieczeństwa.

Źródła

- Oasis Security — Claude.ai Exploit Chain: Full Technical Report

- Oasis Security — Claudy Day: Chaining Prompt Injection and Data Exfiltration in Claude.ai

- Dark Reading — ‘Claudy Day’ Trio of Flaws Exposes Claude Users to Data Theft

- Cyberflux — Prompt injection po erze prostych analogii. Prawdziwy problem zaczyna się tam, gdzie agent może działać

Nie nowy atak, tylko naprawiony błąd. Co łatka Gemini CLI mówi o tym, że tryb –yolo w potoku CI/CD to nie jest dobry pomysł