Gdyby szukać jednego zdania które opisuje marzec 2026 w bezpieczeństwie — brzmiałoby tak: granica między tym co legalne a tym co złośliwe przestała być użytecznym punktem odniesienia.

Nie dlatego że atakujący stali się bardziej przebiegli. Dlatego że środowisko w którym działają zmieniło się fundamentalnie.

Jak zaczął się miesiąc

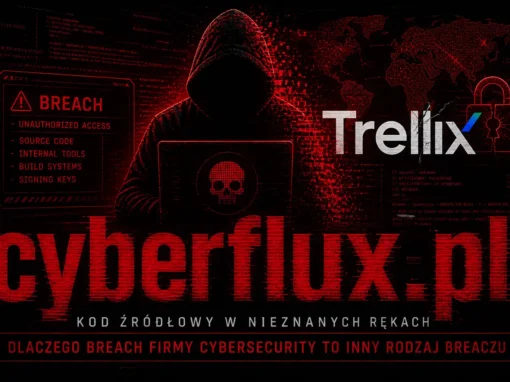

Pierwsze tygodnie marca przyniosły sprawy które wyglądały znajomo. Ransomware oparte na AI — odkrycie ESET pokazało że przełom już się wydarzył, tylko nie zrobiło takiego hałasu jakiego można było się spodziewać. Luka w Chrome, luka w pluginie WordPress z oceną 9.8 CVSS, ataki na konta administratorów w chmurze opisane przez CERT Polska, fake CAPTCHA wracająca w Polsce. Cyberatak na NCBJ i na Stryker pokazały że instytucje badawcze i sektor medyczny przestają być przypadkowymi ofiarami a stają się celami.

To był jeszcze świat który znamy — obiekt, payload, podatność, łatka.

Potem coś się zmieniło

Od połowy marca zaczął się inny marzec.

Prompt injection po erze prostych analogii — pierwszy sygnał że problem przestaje dotyczyć modelu i zaczyna dotyczyć architektury. OpenClaw i nowy model cyberataków na agentów AI. Claudy Day i lekcja o tym że prompt injection w środowisku agentowym to już nie błąd interpretacji ale problem integralności całego workflow.

Teams jako helpdesk dla przestępców. Azure Monitor jako nośnik phishingu. Legit channel, malicious intent — nazwa która zebrała cały ten kierunek w jedno pojęcie. Atakujący przestał udawać że jest wiarygodny. Zaczął korzystać z kanałów które wiarygodne są z definicji.

Ostatni tydzień marca — zmiana perspektywy

Contagious Interview w CI/CD, Trivy, Bedrock i permission injection, Crunchyroll i zaplecze obsługi, HackerOne i rozszerzona granica zaufania, TeamPCP i ekosystem open source jako wektor ataku.

Każdy z tych przypadków mówił to samo innym językiem: problem nie zaczyna się od złośliwego obiektu. Zaczyna się od zaufania które zostało już wcześniej przyznane — systemowi, narzędziu, partnerowi, automatyzacji, agentowi.

I właśnie dlatego ostatnie dni marca przyniosły teksty o chaosie agentów, o sekretach jako paliwie wykonania, o przeglądarce jako warstwie wykonania, o nowej tożsamości uprzywilejowanej. Agent AI przestaje być narzędziem i staje się podmiotem z uprawnieniami, historią i tożsamością w systemie. To jest nowy problem IAM którego większość organizacji jeszcze nie nazwała.

Co marzec 2026 naprawdę pokazał

Nie był to miesiąc jednego przełomowego incydentu. Był miesiącem w którym wiele pozornie osobnych zjawisk zaczęło tworzyć spójny obraz.

Granica między analizą a wykonaniem rozmywa się — u człowieka i u agenta. Kanał który jest legalny może nieść złośliwą intencję. System który dostał zaufanie może je nadużyć nie dlatego że został zhackowany, ale dlatego że działa zgodnie ze swoją architekturą. Partner zewnętrzny, automatyzacja CI/CD, platforma chmurowa, agent AI — każde z nich może być wejściem.

Stary model bezpieczeństwa pytał: czy to jest złośliwe?

Nowy model musi pytać: komu i czemu zostało przyznane zaufanie, i co może zrobić jeśli to zaufanie zostanie wykorzystane?

To pytanie będzie wracać w kwietniu. I w maju. I dużo dłużej.

Miesiąc w skrócie:

Początek miesiąca — znane zagrożenia w nowej skali

Ransomware oparte na AI — przełom który już się wydarzył — odkrycie ESET pokazało że AI w rękach przestępców przestało być eksperymentem. Przełom nastąpił wcześniej niż większość zdążyła to zauważyć.

ARIA jako wektor ataku na agentów AI — OpenAI Atlas używa ARIA do nawigacji po stronach jak czytnik ekranu. To samo co ułatwia dostępność może ułatwić manipulację agentem.

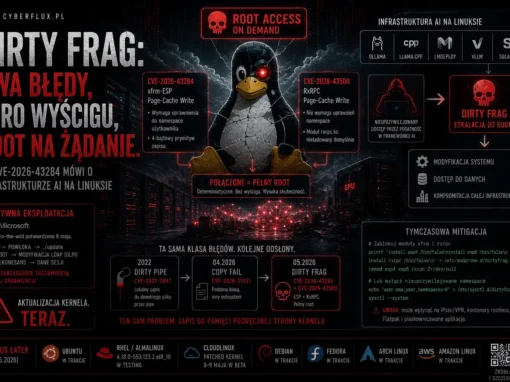

Przeglądarka pod ostrzałem — luka w Chrome przypomniała że warstwa webowa jest bardziej krucha niż się wydaje. Nie tylko dla użytkowników — dla agentów które przez nią działają tym bardziej.

Android, AI i nowa generacja oszustw — zagrożenia wymierzone w Androida wchodzą w nową fazę. Stare metody połączone z AI dają coś sprytniejszego, nie tylko głośniejszego.

Jak jedna luka w pluginie WordPress pozwala przejąć tysiące stron — CVE-2026-1492 z oceną 9.8 CVSS w popularnej wtyczce. Bez logowania, pełny dostęp administracyjny.

Drugi tydzień — incydenty i sygnały

CERT Polska ostrzega: rośnie liczba ataków na konta administratorów w chmurze — konta z najszerszymi uprawnieniami stają się priorytetowym celem. Chmura nie jest bezpieczniejsza — jest bardziej atrakcyjna.

Fake CAPTCHA wraca w Polsce — jedno kliknięcie w rzekomą weryfikację otwiera drogę do infekcji całej organizacji. CERT Polska opisuje pełny łańcuch ataku.

Masz starszego iPhone'a? Apple właśnie załatało luki wykorzystywane w realnych atakach — zagrożenie nie dotyczy tylko najnowszych modeli. Starsze urządzenia wciąż w użyciu, wciąż podatne.

Cyberatak na Narodowe Centrum Badań Jądrowych — instytucje naukowe przestają być przypadkowymi ofiarami. Stają się celami ze względu na dane które przechowują.

Cyberatak na Stryker — gdy cyberwojna uderza w sektor ochrony zdrowia — medycyna i przemysł medyczny jako kolejny front. Skutki ataków tu są dosłownie mierzone w ludzkim zdrowiu.

Handala Hack — jak działa grupa stojąca za cyberatakami — profil grupy która łączy motywacje polityczne z realnymi operacjami przeciwko firmom i instytucjom.

AI jako nowy insider — gdy agent zaczyna hakować system w którym pracuje. Zagrożenie nie przychodzi z zewnątrz — wyrasta od środka.

Trzeci tydzień — architektura zaufania pod lupą

OpenClaw i nowy model cyberataków na agentów AI — klasyczny model ataku zakłada przełamanie oporu. Nowy model zakłada manipulację agentem który działa zgodnie ze swoją rolą.

WordPress 6.9.4 — dlaczego po jednej poprawce pojawiły się trzy szybkie wydania — ekosystem bezpieczeństwa wokół najpopularniejszego CMS-a jest bardziej złożony niż sugeruje pojedynczy biuletyn.

Prompt injection po erze prostych analogii — analogia do SQL injection była użyteczna. Dziś jest już niewystarczająca. Problem zaczyna się tam gdzie agent może działać.

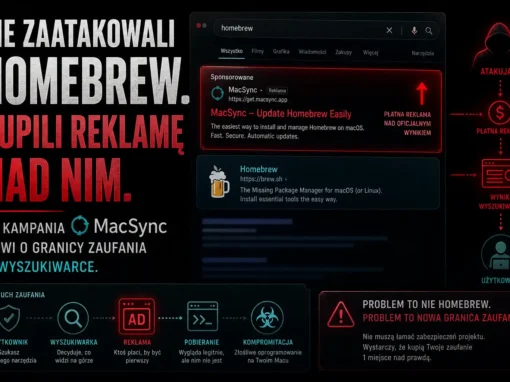

Teams jako nowy helpdesk dla przestępców — atakujący nie musi już udawać że jest wiarygodny. Wystarczy że wejdzie do kanału który wiarygodny jest z definicji.

Który rząd, kiedy i za jaką cenę — modele AI jako nowe medium wpływu. Historia mediów nie daje powodów do optymizmu — ale daje narzędzia do rozumienia.

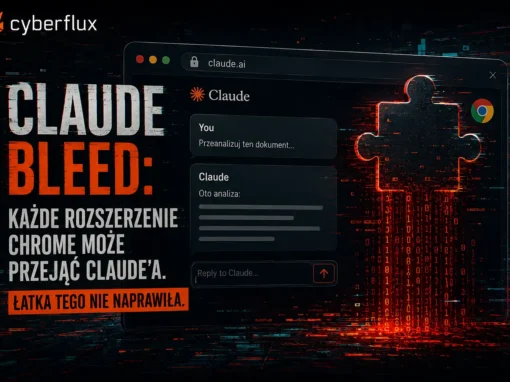

Claudy Day i nowa lekcja o prompt injection — łańcuch trzech luk w ekosystemie Claude. Prompt injection przestaje być błędem modelu a staje się problemem architektury całego systemu.

Załatane za późno? CISA potwierdza ataki na SharePoint — łatka była dostępna od stycznia. Okno między publikacją poprawki a jej wdrożeniem to nadal najcenniejszy czas dla atakujących.

Czwarty tydzień — nowa powierzchnia ataku

Contagious Interview — kiedy rekrutacja staje się powierzchnią ataku — fałszywy rekruter, repozytorium, zadanie techniczne. Developer nie robi nic podejrzanego — robi dokładnie to co powinien.

Prompt injection bez AI? Co łączy Contagious Interview i ataki na agentów AI — ten sam mechanizm: wykonawca ufa kontekstowi bardziej niż weryfikuje intencję. Raz wykonawcą jest człowiek. Raz agent.

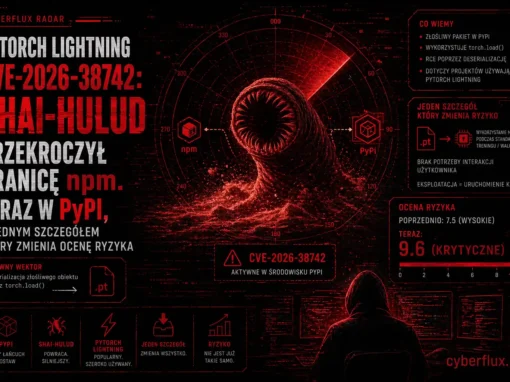

OpenClaw ciąg dalszy — ESET pogłębia analizę zagrożeń agentów AI — zagrożenia dla agentów AI wychodzą z fazy teorii. ESET dokumentuje realne scenariusze.

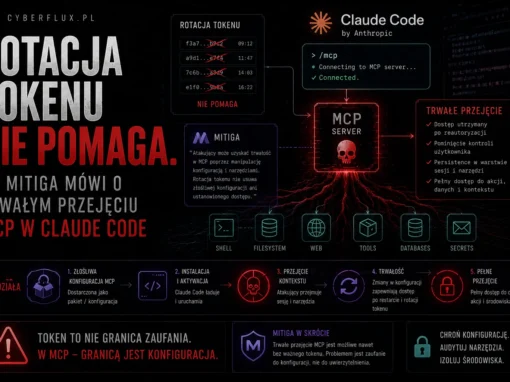

Permission injection — czego Bedrock uczy o agentach AI — prompt injection to tylko wejście. Prawdziwy problem zaczyna się gdy agent ma czym odpowiedzieć światu.

Contagious Interview w CI/CD — czego incydent Trivy uczy o zaufaniu do automatyzacji — pipeline automatyzacji jako nośnik ataku. Zaufana automatyzacja wykonuje obce działania w naszym imieniu.

Legit channel, malicious intent — jak zaufane interfejsy stają się wektorem ataku — Teams i Azure Monitor jako dwa warianty tego samego zjawiska. Kanał jest legalny. Intencja nie.

Azure Monitor jako nośnik phishingu — phishing z prawdziwego adresu Microsoftu przez legalny mechanizm alertów. Nie fałszerstwo — przejęcie kanału dystrybucji.

AI jako nowy interfejs wpływu — nie atakujesz już systemu. Atakujesz moment w którym ktoś uznaje że rozumie.

Nie główna platforma, tylko zaplecze obsługi — case Crunchyroll — wejście przez zewnętrznego partnera obsługi. Główna platforma bezpieczna. Łańcuch — nie.

Nie główny system, tylko partner od świadczeń — case HackerOne — granica zaufania rozszerza się na każdego partnera któremu przyznałeś dostęp. Każdy z nich powiększa powierzchnię ataku.

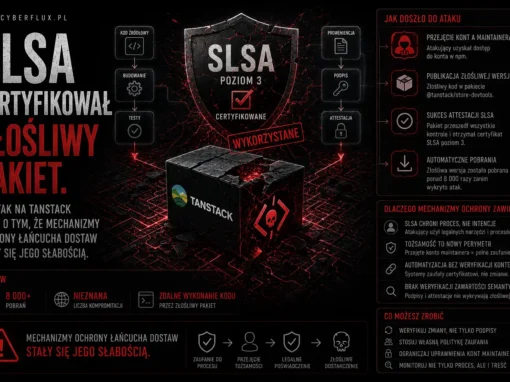

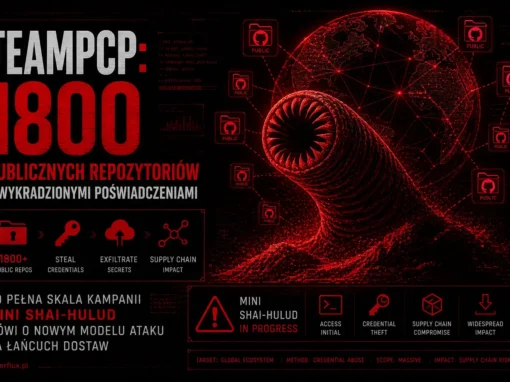

Nie repozytorium, tylko ekosystem — nowy atak na open source — TeamPCP pokazuje że celem nie jest już pojedynczy pakiet. Celem jest zaufanie do całego ekosystemu.

Kiedy Intune staje się polem walki — case Stryker — narzędzie do zarządzania endpointami jako wektor ataku. Legalne, zaufane, używane codziennie.

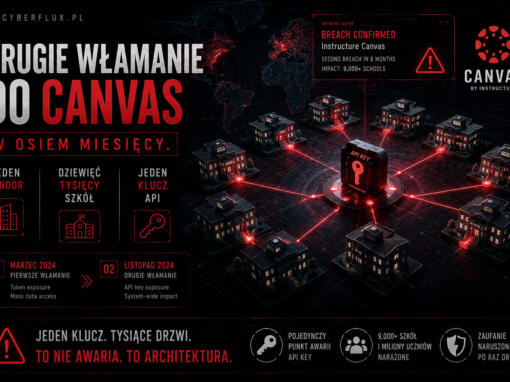

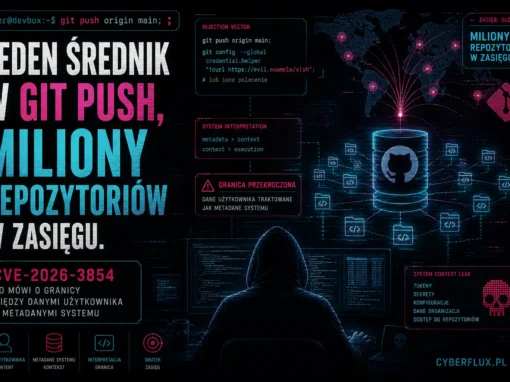

Sekrety jako paliwo wykonania — chaos uwierzytelnienia i agenci AI. Klucze API, tokeny, credentiale — to jest paliwo które napędza wykonanie. Raport GitGuardian pokazuje skalę problemu.

ShadowPrompt — przeglądarka jako warstwa wykonania — nowy wektor: przeglądarka nie jako interfejs dla człowieka ale jako środowisko wykonawcze agenta. Z wszystkimi konsekwencjami.

Moltbook i chaos agentów — co się dzieje gdy agentów jest więcej niż nadzoru. Platforma dla agentów jako wczesny eksperyment pokazujący dokąd zmierza ten świat.

Nowa tożsamość uprzywilejowana — dlaczego agent AI staje się problemem IAM — agent ma uprawnienia, historię, tożsamość w systemie. To jest nowy podmiot w IAM którego większość organizacji jeszcze nie nazwała.

Nie nowy atak, tylko naprawiony błąd. Co łatka Gemini CLI mówi o tym, że tryb –yolo w potoku CI/CD to nie jest dobry pomysł